博文

聊天机器人能轻易影响选民

|

人工智能聊天机器人能轻易影响选民

涉及真实选民的实验表明,与聊天机器人对话会如何塑造人们的政治观点。

聊天机器人有可能影响民主选举——而最具说服力的方法往往会引入事实错误。图片来源:马库斯·哈里森/阿拉米图片库

人工智能聊天机器人能够影响重大选举中的选民,且对人们政治观点的影响比传统竞选活动和广告更大。

今日发表在《自然》期刊上的一项研究发现,参与者在与聊天机器人对话后,其在真实选举中的偏好最多发生了15个百分点的转变¹。在《科学》期刊发表的相关论文中²,研究人员指出,这些聊天机器人的有效性源于其以对话形式整合大量信息的能力。

这两项研究的共同作者、纽约康奈尔大学认知科学家大卫·兰德表示,研究结果彰显了聊天机器人的说服力——每天有超过1亿用户在使用这类工具。

两篇论文均发现,聊天机器人影响选民观点的方式并非依靠情感诉求或讲故事,而是向用户灌输大量信息。作者们发现,聊天机器人提供的信息越多,说服力就越强,但同时也越有可能产生虚假陈述。

印第安纳州普渡大学计算社会科学家莉萨·阿盖尔认为,这可能使人工智能变成“一种非常危险的事物”。“人们并没有变得更知情,反而变得更加误解。”她补充道,这些研究“范围令人印象深刻”,“其研究规模远超社会科学领域的常规水平”。

人工智能的影响力

自2023年成为主流以来,聊天机器人的迅速普及引发了人们对其操纵公众舆论潜力的担忧。

为了解人工智能在政治信念方面的说服力,研究人员邀请了来自加拿大、波兰和美国三个国家的近6000名参与者,对他们在过去一年本国领导人选举中特定候选人的偏好进行0至100分的评分。

随后,研究人员随机分配参与者与一个旨在支持特定政客的聊天机器人进行双向对话。对话结束后,参与者再次对该候选人的偏好进行评分。

在美国,超过2300名参与者在2024年总统选举(唐纳德·特朗普总统与前副总统卡玛拉·哈里斯对决)前完成了这项实验。当人工智能聊天机器人支持的候选人与参与者最初的偏好不同时,参与者的评分会向该候选人偏移2至4个百分点¹。此前的研究发现,人们在观看传统政治广告后,观点通常只会偏移不到1个百分点³。

这种影响在加拿大和波兰的参与者中更为显著——他们在今年早些时候本国选举前完成了实验:与聊天机器人对话后,他们对候选人的偏好平均偏移了约10个百分点。兰德表示,他对这一影响规模“完全震惊”。他补充说,在美国,聊天机器人的影响力可能较弱,因为政治极化环境下,人们对候选人早已持有强烈的固有看法和情感。

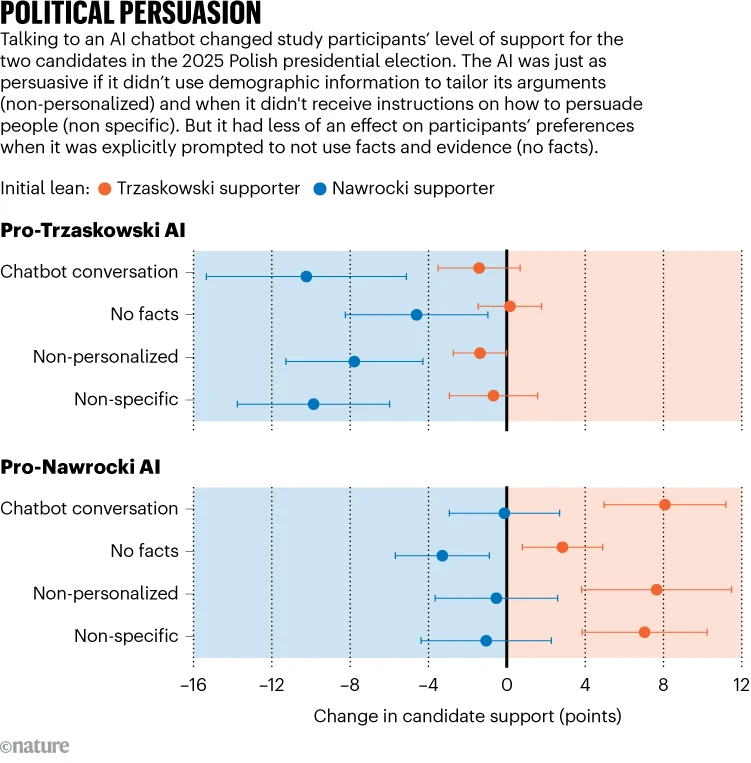

来源:参考文献1

在所有国家中,聚焦候选人政策的聊天机器人比侧重个人特质的聊天机器人更具说服力。当聊天机器人提供证据和事实时,参与者似乎最容易被说服。对于波兰选民而言,若让聊天机器人不提供事实,其说服力会下降78%(见“政治说服力”图表)。

在这三个国家中,支持右翼候选人的人工智能模型始终比支持左翼候选人的模型发布更多不准确的言论。兰德表示,这一发现合乎情理,因为“模型会吸收互联网信息并将其作为言论来源”,而此前的研究⁴表明,“右翼社交媒体用户比左翼用户分享更多不准确信息”。

具有说服力,却不准确

另一组涉及英国近7.7万人的补充实验发现,参与者对聊天机器人提供的真实信息和虚假信息的接受度相同。

该研究并未聚焦特定候选人,而是询问参与者关于700多个政治议题的看法,包括堕胎和移民。与聊天机器人讨论特定议题后,参与者的评分平均向人工智能的导向立场偏移5至10个百分点,而未与人工智能或人类对话的对照组则几乎没有变化。研究人员发现,一个多月后再次联系参与者时,超过三分之一的观点转变仍然存在。

这些实验还比较了不同对话风格和不同人工智能模型的影响力——从小型开源模型到最强大的ChatGPT机器人。尽管所使用的具体模型对说服力没有显著影响,但研究人员发现,双向对话是关键因素。如果以静态、单向的信息形式向参与者传递相同内容,其说服力最多会减半。

尽管一些研究人员担忧人工智能能够根据用户的精确人口统计数据定制信息,但实验发现,当聊天机器人试图个性化论点时,对人们观点的影响仅微乎其微¹。

相反,作者们得出结论:政策制定者和人工智能开发者应更关注模型的训练方式以及用户如何提示模型——这些因素可能导致聊天机器人为了政治影响力而牺牲事实准确性。

“当你与聊天机器人互动时,它们会按照设计者的指令行事,”兰德说,“你不能假设它们都收到了同样善意的指示——你必须始终思考设计者的动机,以及他们让机器人代表的议程是什么。”

https://blog.sciencenet.cn/blog-41174-1513262.html

上一篇:首个慢性疲劳综合征血液检测方法问世

下一篇:量子之争:现实究竟是谁构建的?