博文

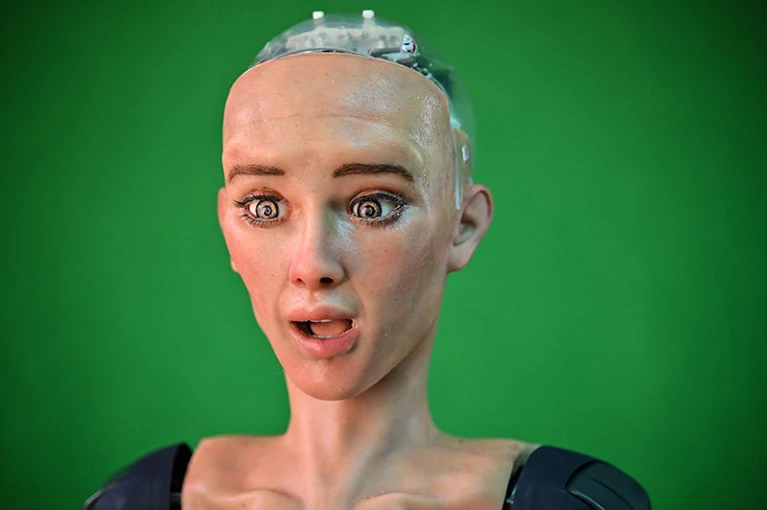

人工智能能否变得有意识?

|

人工智能(AI)系统能否变得有意识?一个由意识科学家组成的联盟表示,目前还没有人知道,并且对缺乏对这个问题的调查表示担忧。

在对联合国的评论中,数学意识科学协会(AMCS)的成员呼吁提供更多资金来支持意识和人工智能的研究。他们说,迫切需要对有意识和无意识系统之间的界限进行科学调查,他们列举了伦理、法律和安全问题,这些问题使得理解人工智能意识变得至关重要。例如,如果人工智能发展出意识,是否应该允许人们在使用后简单地将其关闭?

AMCS董事会成员、英国牛津的数学家乔纳森·梅森(Jonathan Mason)表示,在最近关于人工智能安全的讨论中,这种担忧大多没有出现,例如在英国举行的备受瞩目的人工智能安全峰会。美国总统乔·拜登(Joe Biden)寻求负责任地开发人工智能技术的行政命令也没有解决有意识的人工智能系统提出的问题。

“随着人工智能领域发生的一切,不可避免地会有其他相邻的科学领域需要迎头赶上,”梅森说。意识就是其中之一。

这不是科幻小说

科学界还不知道是否存在或将会有意识的人工智能系统。梅森说,即使知道是否已经开发出一种技术也是一个挑战,因为研究人员还没有创造出经过科学验证的方法来评估机器的意识。“鉴于人工智能的进步速度,我们对人工智能意识的不确定性是我们应该担心的关于人工智能的众多事情之一,”加利福尼亚州旧金山非营利性研究组织人工智能安全中心的哲学家罗伯特·朗说。

这种担忧不再只是科幻小说。OpenAI(创建聊天机器人ChatGPT的公司)等公司的目标是开发通用人工智能,这是一种深度学习系统,经过训练可以执行类似于人类可以完成的各种智力任务。一些研究人员预测,这将在 5-20 年内成为可能。即便如此,意识研究领域“非常缺乏支持”,梅森说。他指出,据他所知,2023 年还没有一项资助来研究这个主题。

AMCS向联合国人工智能高级别咨询机构提交的文件中概述了由此产生的信息差距,该机构于10月启动,并计划在2024年年中发布一份关于世界应如何管理人工智能技术的报告。AMCS提交的文件尚未公开发布,但该机构向AMCS证实,该小组的评论将成为其“基础材料”的一部分,这些材料为其关于人工智能系统全球监督的建议提供了信息。

AMCS的研究人员说,了解什么可以使人工智能有意识,对于评估有意识的人工智能系统对社会的影响是必要的,包括它们可能的危险。人类需要评估这些系统是否共享人类的价值观和利益;否则,它们可能会对人们构成风险。

机器需要什么

但研究人员说,人类也应该考虑有意识的人工智能系统的可能需求。这样的系统会受到影响吗?如果我们不认识到人工智能系统已经变得有意识,我们可能会给有意识的实体带来痛苦,Long说:“我们并没有真正将道德考虑扩展到外观和行为都不像我们的实体的良好记录。他说,错误地归因于意识也是有问题的,因为人类不应该花费资源来保护不需要保护的系统。

AMCS提出的一些问题强调了意识问题的重要性,这些问题是合法的:一个有意识的人工智能系统是否应该对蓄意的不法行为负责?它应该被授予与人相同的权利吗?该联盟写道,答案可能需要改变法规和法律。

然后,科学家需要教育他人。梅森说,随着公司设计出功能越来越强大的人工智能系统,公众会怀疑这些系统是否具有意识,科学家需要知道足够的知识来提供指导。

其他意识研究者也表达了这种担忧。位于博卡拉顿的佛罗里达大西洋大学未来思维中心主任、哲学家苏珊·施耐德(Susan Schneider)表示,ChatGPT等聊天机器人的行为似乎非常像人类,人们有理由对它们感到困惑。如果没有科学家的深入分析,有些人可能会得出结论,认为这些系统是有意识的,而其他公众可能会对人工智能意识不屑一顾,甚至嘲笑。

为了降低风险,包括数学家、计算机科学家和哲学家在内的AMCS呼吁政府和私营部门资助更多关于人工智能意识的研究。推进该领域并不需要太多资金:尽管迄今为止的支持有限,但相关工作已经在进行中。例如,Long和其他18名研究人员已经制定了一个标准清单,以评估一个系统是否有很高的意识机会。论文1该论文于8月发表在arXiv预印本存储库中,尚未经过同行评审,其标准来自解释意识生物学基础的六种著名理论。

“有很大的进步潜力,”梅森说。

https://blog.sciencenet.cn/blog-41174-1414904.html

上一篇:为了完成使命中性粒细胞会死两次

下一篇:浙大柏浩/高微微团队开发仿生北极熊毛衣