博文

迷信人工智能技术可能导致基础研究停滞:评2024年诺贝尔物理学奖  精选

精选

||

2024年的诺贝尔物理学奖出现了一个重大的意外,居然将该奖颁发给了两位人工智能专家。而且给出的理由也非常图灵化:表彰他们在人工神经网络和机器学习的基础性贡献。乍一看,还以为是颁发图灵奖。两位获奖者都莫名惊诧,辛顿在接到获奖电话的第一反应是“这不会是恶作剧电话吧?” 另一个获奖者霍普菲尔德收到消息时,也感到“非常惊讶”。

诺奖颁发出现这么大的乌龙。只能有两种可能:1)当今物理学已无重大发现,不管是高能物理、还是量子物理都无重大发现,相信广大物理学家肯定不会同意;2)诺贝尔奖评选委员会已失去公信力,他们也在赶时髦,人工智能太热,他们就选人工智能专家。人工智能的拥护者表示AI能渗透和引领一切学科,包括物理学。照这个趋势,以后诺贝尔科学奖的各个奖项都可以颁发给人工智能学家,因为在每个学科在处理数据时候,或多或少会用点人工智能技术。

基于数据驱动的神经网络到底能否取代物理学家,发现物理规律呢?我认为几乎是不可能的。幸好牛顿、爱因斯坦没有生活在我们时代,否则万有引力和相对论可能永远发现不了。太依赖AI技术,太相信数据驱动,太迷信神经网络,将会导致物理学家不太相信自己的观察力、洞察力和领悟力,反而会使得物理学等基础研究陷于停滞。

我们就举一个简单的例子来说明这一点。牛顿在苹果树下被苹果砸中脑袋而顿悟出的伟大的万有引力公式,F=g*m1*m2/r^2。该公式简单,只有一个可调参数g,方便记忆。该公式可解释性强,从公式中,我们可以获取知识:质量越大引力越大,距离越远引力越小。该公式泛化能力强,适应各种情况,没有机器学习算法要求的参数范围这类的约束条件。

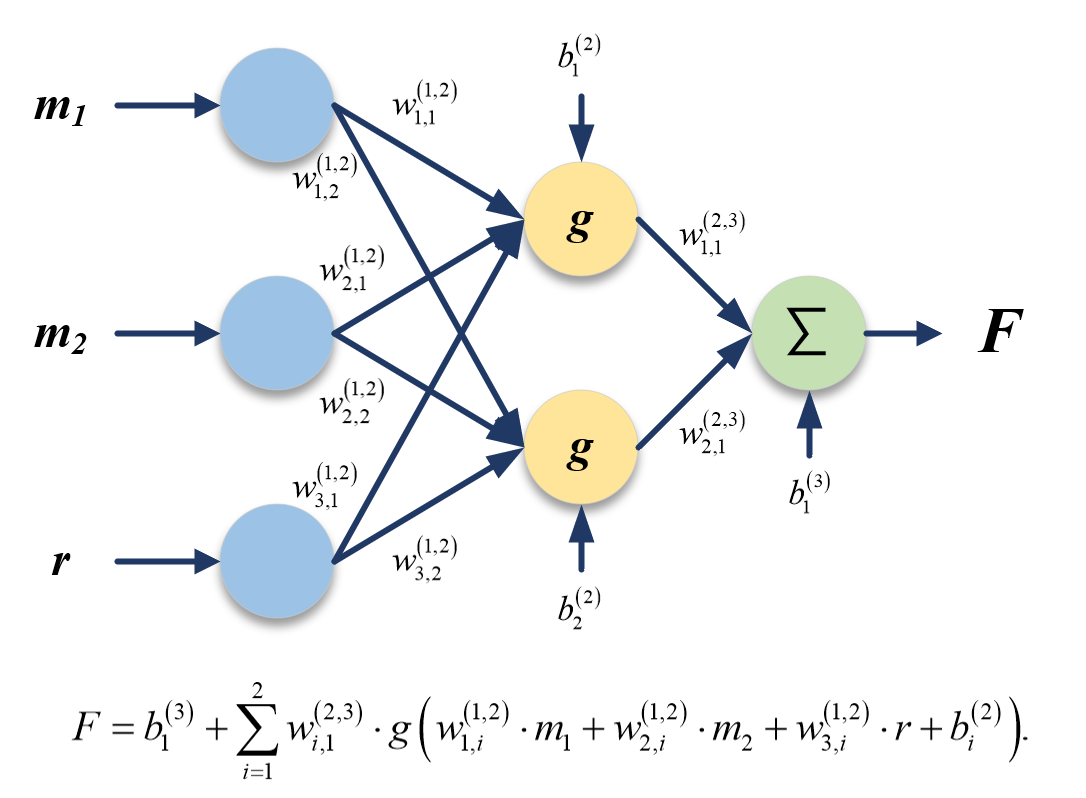

如果我们用神经网络来学习万有引力公式,那么我们将有3个输入:m1,m2和r。一个输出F。最简单的神经网络应该有2个隐层节点。这样我将有6个节点,8个权重参数,3个可调节神经元偏置参数。

该神经网络模型共有11个参数需要学习,非常难以记忆。其次,该模型的每个参数没有明确的物理意义,可解释性很差。最后,该神经网络模型的参数与训练数据密切相关,不同的数据学习出的参数不同,让人各执一词。该神经网络模型对数据依赖性强,数据不好,性能很差,泛化性能也很弱。

总之,把人类科研创新的希望寄托于大数据,寄托于神经网络这类技术,将会导致人类的思考能力变弱,也许会使得基础研究停滞。复杂的神经网络的参数太多、可解释性差,而且所耗费硬件成本很高,能耗很高,难以可持续发展。尤其,神经网络是个黑盒,即使从数据中学到一些规则,也知其然不知其所以然,让人茫然不知所措。尤其,可解释性差的神经网络在遇到异常输入时,很可能出现更异常的输出,系统的安全性也难以保证。

诺贝尔情结

https://blog.sciencenet.cn/blog-57940-1454491.html

上一篇:奥运团队的他山之石可以攻科技创新之玉

下一篇:38岁的诺奖得主给年轻人才成长的几点启示