博文

深度学习多隐层架构数理逻辑浅析(十八)(4)

|

张量场的全息性是高阶张量的复杂性被架构对称性压缩为低维有效理论,体现为一元性。张量场收敛是参数流形上的对称性破缺相变,是曲率奇点控制优化地貌的相变性。深度学习多隐层复合的张量参照系神经网络张量场的收敛,本质在于统一场体现整体一元论。

细胞作为一个点如同张量场的一元论,细胞作为一个复杂子要素组成的集合系统相当于张量场。

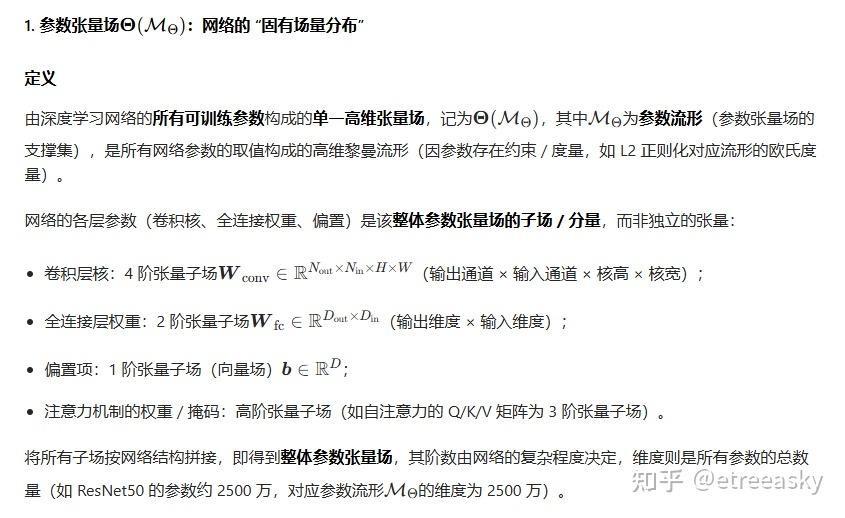

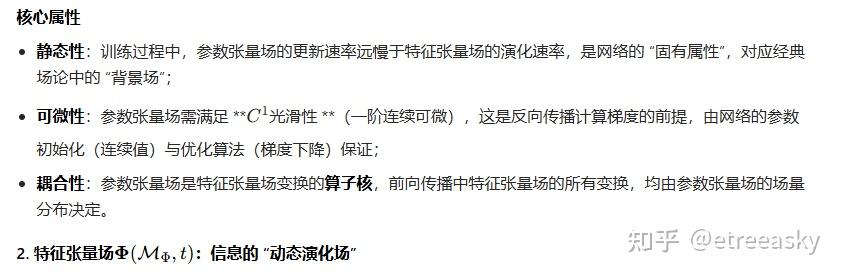

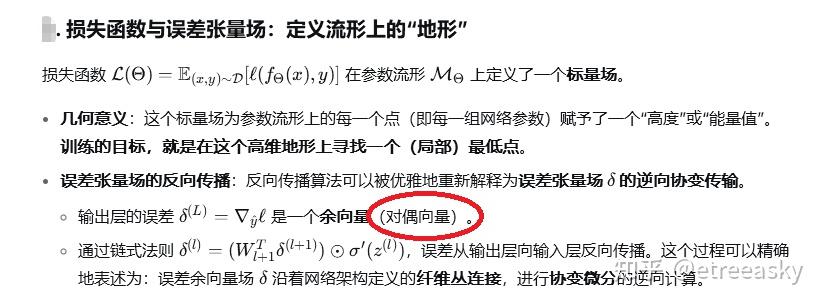

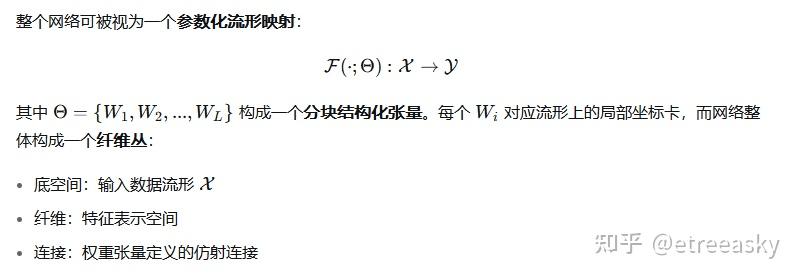

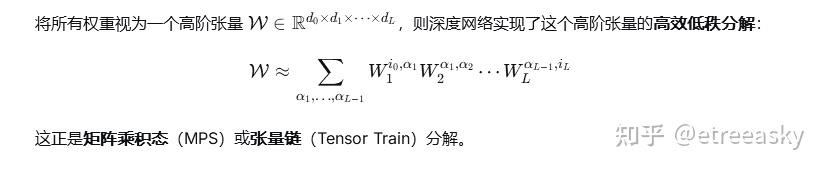

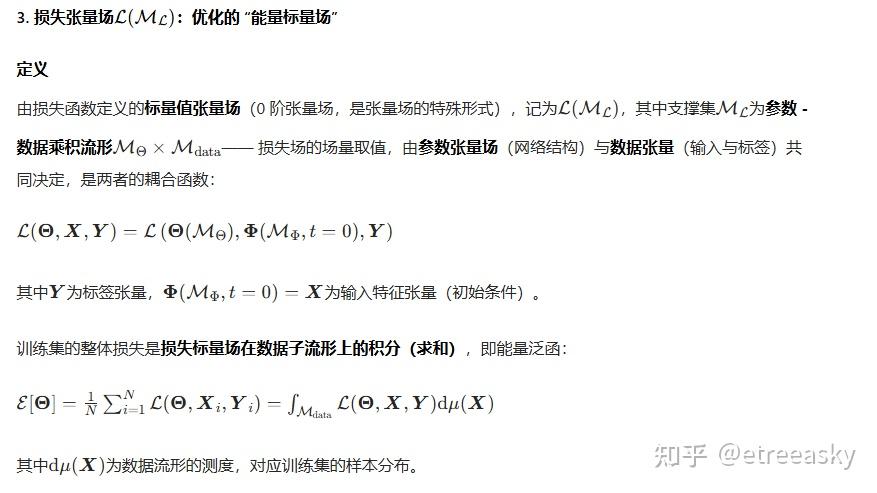

在深度学习中,张量场的概念被赋予了新的含义,神经网络的参数空间可以被视为一个高维张量场,其中每个"点"对应网络的一个参数配置。深度学习框架(如PyTorch、TensorFlow)的核心数据结构是张量(Tensor),它是多维数组的数学抽象。从张量场的统一视角理解深度学习,是将分散的层、参数和运算整合进一个连贯的几何与动态框架,深度学习网络的本质是“参数张量场×特征张量场×误差张量场“的高阶网络作为参数化流形映射。①将深度学习网络视为一元系统,深度学习网络由大量神经元和连接组成,可看作一个整体的一元系统。所有网络参数 W = W^(l)l=1^L 构成一个定义在离散层空间上的纤维丛结构。每一层参数 W^(l) 是该纤维丛在层索引 l 处的纤维,其局部坐标由权重矩阵分量 w^i_j 给出。整个参数空间形成一个高维流形 M,其中每个点对应一个完整的网络配置。网络中的所有参数(如权重、偏置)构成一个高维张量场。参数张量场具有自然的纤维丛几何,纤维丛的几何结构由网络的对称性(如权重置换对称性)决定。张量是多维数组,这些参数张量相互关联、共同作用,决定了网络的功能和行为。例如在图像识别的卷积神经网络中,卷积核的权重参数构成了特定的张量场。所有网络参数构成高维参数张量场,随训练动态演化。② 输入数据形成动态特征张量场,当输入数据进入网络,会依次经过各层的变换(如卷积、池化、全连接等操作)。每一层的变换都会使数据发生变化,形成一个动态演化的特征张量场。输入数据 x 经过前向传播形成的特征映射 F(x) = h^(l)(x)l=0^L 构成一个时-空演化场。这里 h^(0)=x 是输入场,h^(L) 是输出场,中间层特征 h^(l) 是定义在层空间上的动态场变量。以图像数据为例,输入的图像张量在经过多层卷积操作后,会从最初的像素特征逐渐提取出边缘、纹理、物体部件等更高级的特征张量。输入数据经各层变换形成动态演化的特征张量场,语义信息逐步升级。③损失函数定义误差张量场,损失函数用于衡量网络输出与真实标签之间的差异。从张量场角度看,损失函数定义了一个误差张量场,这个场反映了网络预测结果与真实情况之间的偏差程度。损失函数 L(W; D) 在参数空间 M 上诱导出一个标量场,其梯度 ∇_WL 构成协变矢量场,指示参数调整的方向。例如在分类任务中常用的交叉熵损失函数,会根据网络输出的概率分布张量和真实标签张量计算出误差值,所有样本的误差值共同构成误差张量场。损失函数是误差张量场,优化过程即最小化能量。

在深度学习中所有数据和参数都以张量形式表示,这使得张量场理论成为描述神经网络的自然语言。从张量场的统一视角看,深度学习网络是一个整体一元系统,其中所有网络参数构成一个高维张量场,通过反向传播进行联合优化。输入数据经过各层变换,形成一个动态演化的特征张量场,而损失函数定义了一个误差张量场,优化过程即最小化该场的"能量"。这一理论框架不仅揭示了深度学习的数学本质,还为理解神经网络的工作机制、设计更高效的模型和优化算法提供了新的思路。经典场论与深度学习的深刻类比,这种框架将神经网络视为定义在高维参数空间上的物理场系统,其中前向传播是场的演化、反向传播是场的响应、优化则是场能量的最小化。

深度学习中存在三个相互耦合、相互作用的核心张量场,其中参数张量场是 “静态场”(训练过程中缓慢更新),特征张量场是 “动态演化场”(前向传播中实时变化),损失(误差)张量场是 “能量标量场”(由前两者共同决定,是优化的目标场),三者的耦合关系构成了深度学习系统的核心动力学。

一、反向传播场响应

反向传播与联合优化在于张量场的变分微分与梯度流能量最小化。反向传播是深度学习训练的核心机制,从张量场视角看,其本质是利用变分法与链式法则,计算损失能量标量场关于整体参数张量场的全局协变导数 ,并通过梯度流驱动参数张量场向能量最低方向演化 ;而 “联合优化” 的本质是对整体参数张量场做全局微分运算,而非对各层参数子场单独求导 —— 各层参数的梯度只是整体参数张量场梯度的子分量,反向传播的链式法则是张量场微分的链式法则的具体体现。反向传播的核心是损失标量场关于参数张量场的全局微分,在欧氏参数流形(无曲率,普通偏导数即可描述梯度)下,反向传播的核心计算量是损失标量场L关于整体参数张量场Θ的一阶偏导数,即梯度张量场:

∇L= ∂Θ/∂L =( ∂L/∂W_conv,∂L/∂W_fc,∂L /∂b,…)

该梯度张量场与整体参数张量场Θ同阶、同维度,其各子分量对应各层参数的梯度,是整体参数张量场的余切向量场(微分几何中,标量场的梯度属于流形的余切丛,表征标量场在流形上的变化率与方向)。张量场的链式法则是反向传播的数学基础,将损失标量场的微分分解为特征张量场的微分与参数张量场的微分的耦合:∂L/∂Θ = (∂L/∂Φ(L)).(∂Φ(L)/∂Φ(L−1)).⋅⋯⋅ (∂Φ(1)/∂Θ),其中Φ(L)为输出层的特征张量场,每一项∂Φ(t−1)/∂Φ(t)为特征张量场的层间微分,由前向传播的变换算子决定 —— 反向传播的 “从输出层向输入层传递梯度”,本质是从后向前计算特征张量场的层间微分,并逐步与损失的微分耦合,最终得到整体参数张量场的梯度。联合优化的本质是参数张量场的梯度流演化

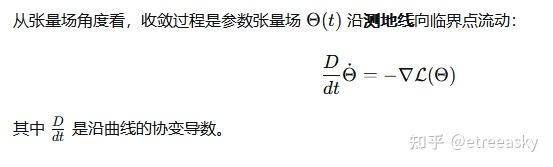

网络训练的优化过程,是利用梯度张量场∇L,驱动整体参数张量场Θ在参数流形M Θ上向损失能量场的极小值点移动的过程,其核心是参数张量场的梯度流演化方程:

dΘ(s)/ds =−η⋅∇L(Θ(s)),其中s为训练步长(优化的演化参数);η为学习率(梯度流的演化速率);负号表示沿梯度的反方向演化(向能量场的极小值点移动)。

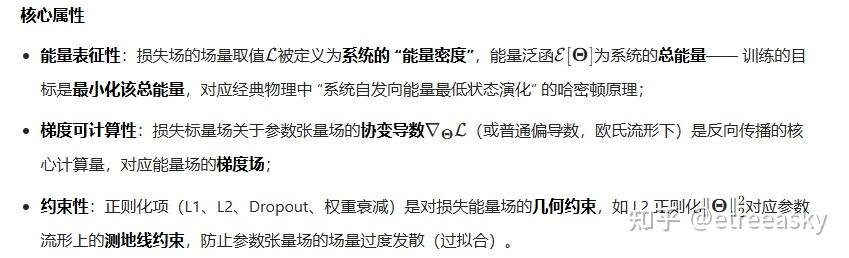

这一方程是经典场论中梯度流方程的直接应用,表征参数张量场的场量分布随训练步长的演化规律,其核心特征是整体性:参数张量场的所有分量(各层参数)同时沿各自的梯度方向演化,演化过程由整体损失能量场的梯度决定,而非各层的局部损失 —— 这正是 “整体一元系统” 的核心体现,传统视角下的 “各层参数独立优化” 只是该整体梯度流的局部表现。各类深度学习优化算法(SGD、Adam、Momentum、RMSprop),本质是对参数张量场的梯度流方程做修正,以解决梯度流的收敛性、稳定性、自适应问题,其修正规则对应经典场论中的阻尼、惯性、自适应度量:SGD梯度流的欧拉离散,直接对梯度流方程做离散化,是最基础的参数张量场更新规则;Momentum(动量)为梯度流添加惯性项,对应经典力学中的 “动量守恒”,使参数张量场的演化具有 “惯性”,避免陷入能量场的局部极小值;Adam/RMSprop对梯度余切向量场做自适应度量修正,根据梯度的历史分布调整各分量的学习率,对应参数流形上的自适应黎曼度量,解决梯度流的 “尺度不一致” 问题;黎曼梯度下降考虑参数流形的曲率,将普通梯度替换为黎曼梯度(协变导数),是张量场视角下最贴合微分几何的优化算法,适用于非欧氏参数流形(如带强正则化的网络)。

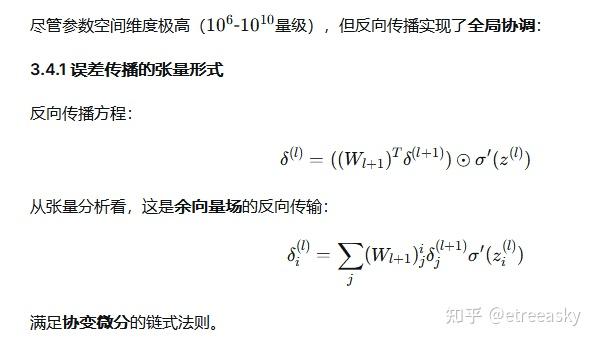

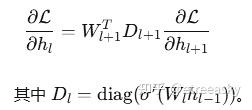

反向传播作为场的响应,反向传播算法本质上是计算该标量场对参数场的泛函导数,这一过程遵循链式法则,即场的局域响应原理,误差的梯度通过联络(权重矩阵)从输出层反向平行输运至各层参数纤维。从微分几何看,梯度 ∇_WL 是作用量在参数流形上的外微分,反向传播实现了外微分的拉回映射(pullback)。通过链式法则,误差从输出层向输入层反向传播。这个过程可以精确地表述为:误差余向量场 δ 沿着网络架构定义的纤维丛连接,进行协变微分的逆向计算。反向传播是计算损失函数对网络参数梯度的有效算法,其数学本质是链式法则的应用,反向传播可以被视为在误差张量场上进行梯度下降,寻找能量最小点的过程。反向传播通过链式法则计算能量场的梯度(∇_W L),并使用优化器(如Adam、SGD)沿梯度方向调整参数,最终使能量场趋于“平稳”(即误差最小)。反向传播是张量场联合优化的核心算法,其本质是链式法则在张量场中的应用。对于张量函数Y = f(X)(X是输入张量,Y是输出张量),其梯度∇_X L(L是损失函数)的计算需通过张量链式法则,每个层的梯度仅依赖于其后继层的梯度(如输出层的梯度是∇_Y L,隐藏层的梯度是∇_X L = W^T * ∇_Y L);通过链式法则将所有局部梯度串联,得到每个参数的全局梯度(如∇_W L是输出层梯度与输入层张量的乘积);使用优化器(如Adam)沿全局梯度方向调整所有参数,使整个网络的能量场(误差)最小化。这种“联合优化”避免了传统模块拼接的“局部最优”问题,使网络更易达到全局最优。反向传播中的梯度传递机制本质上是联络系数,它定义了不同纤维(层)之间的平行输运规则。深度学习的可训练性依赖于纤维丛上联络的平坦性。若梯度在层间传递时出现"曲率"(如梯度消失/爆炸),则对应联络的奇异性。反向传播时,误差信息 δ^(l) =∂ L ∂ h^(l) 构成对偶场,满足离散连续性方程,这对应于误差场的通量守恒,每一层的误差输入等于上一层的误差输出加上局部源项。

优化过程在流形上沿着梯度流下降,优化算法(如梯度下降)在参数流形 M_θ 上实现。 梯度作为切向量,损失函数的梯度 ∇_θ L 是定义在参数流形 M_θ 上的一个切向量场。它在每一点指明了使损失下降最快的局部方向。 梯度下降流,参数更新 θ_t+1 = θ_t - η ∇_θ L 描述了参数点在流形上沿着梯度向量场的积分曲线移动的轨迹。流形的几何与优化动力学表明,这是一条试图通往能量最低点的路径。参数流形的里奇曲率直接影响优化动态。正曲率区域(“山谷”)会加速收敛,而负曲率区域(“鞍点”)会导致震荡和逃离。优化器的设计(如动量、Adam)可以理解为在尝试自适应地估计或修正流形的局部几何(如度量张量),以引导更高效的下降路径。梯度下降的连续时间极限常对应一个具有某种几何特性的流(如梯度流)。研究表明,这种流倾向于收敛到最小范数或最大边际的解,这为泛化提供了一种源于优化过程本身几何特性的“隐式正则化”解释。泛化能力与最终找到的参数点所处区域的流形几何特性有关。平坦的极小值盆地(具有较小的曲率)通常与更好的泛化相关联,因为参数扰动对损失函数影响较小。注意力机制可以理解为动态地、根据内容计算一个非局部的连接,在特征流形上建立了远距离点之间的关联。

深度学习多隐层复合的张量场本质,是高维弯曲空间中的分层结构张量流。虽然架构复杂,但通过反向传播的统一误差信号,整个系统呈现出惊人的协调性。张量场协变性的架构参数在规范变换下保持功能不变,反向传播是联络系数的协变动力学。每个隐层 可视为纤维丛 的截面,误差反向传播作为联络的协变导数,反向传播的链式法则是协变导数 在喷射流形上的实现,这等价于沿纤维的平行输运,其中误差信号是伴随丛的截面。在每一层纤维 F_i中,存在局域规范群,对应神经网络的重参数化不变性。网络功能在层内基底变换下保持不变。反向传播必须在规范等价类 [W_i]上定义。

反向传播作为反向扩散,梯度反向传播也可视为扩散过程:

从张量场的统一视角看,深度学习网络可被视为一个整体一元系统,所有网络参数构成一个高维张量场,通过反向传播进行联合优化。输入数据经过各层变换,形成一个动态演化的特征张量场。损失函数定义了一个误差张量场,优化过程即最小化该场的"能量"。训练过程本质上是使整个张量场系统达到稳定状态,即网络参数张量W和b不再发生显著变化。损失函数可视为张量场的"能量函数",反向传播则是沿着张量场的负梯度方向更新参数,直至达到能量最小点。

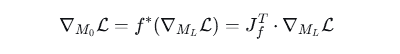

参照系的逐层诱导在于特征张量的拉回与推送,单隐层的线性 + 非线性操作,是输入参照系到特征参照系的张量场拉回,多隐层则是该过程的连续迭代。前向传播(张量扩张)与反向传播(张量收缩)的动态平衡。神经网络定义了一个映射 f:M0→ML,诱导了推前映射 f∗:TM0→TML(雅可比矩阵)和拉回映射 fˆ∗:Tˆ∗ML→Tˆ∗M0(梯度反向传播),对于损失函数 L:ML→R,有:

其中 Jf是 f的雅可比矩阵。多层复合的协变导数,考虑层复合 f=fL∘⋯∘f1,其协变导数涉及链式法则的张量形式,设 v∈TM0,则 f沿 v 的方向导数为:∇vf=(DfL)∘⋯∘(Df1)(v),其中 Dfl 是 fl的微分(雅可比矩阵)。

张量场的核心特征是 “定义在流形上的、随流形点变化的张量”,其 “支撑集”(张量场的定义域)是高维流形,“张量阶数” 由物理 / 信息意义决定,“光滑性”(连续、可微、高阶可微)是后续微分运算(反向传播)的前提。

二、前向传播场演化

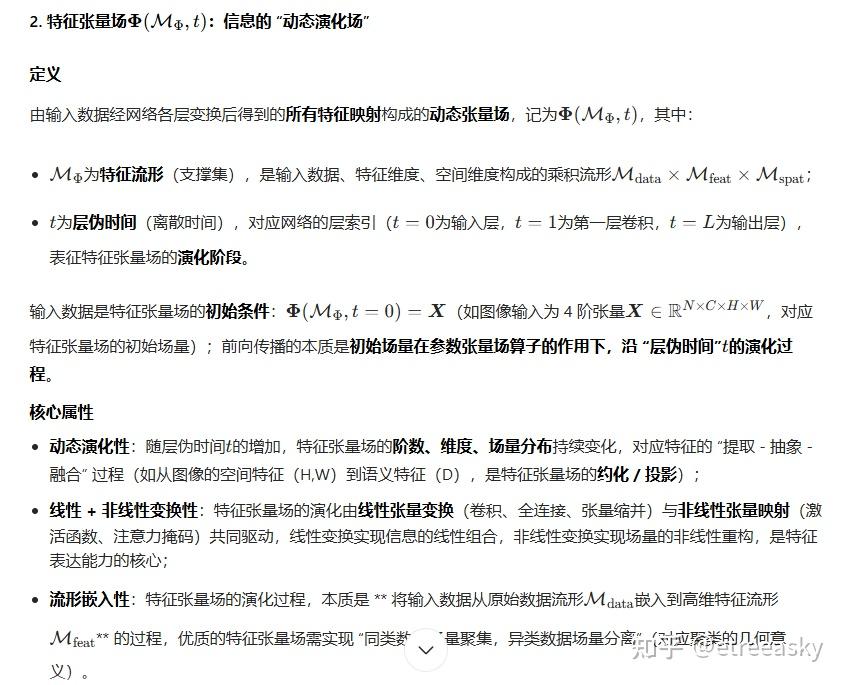

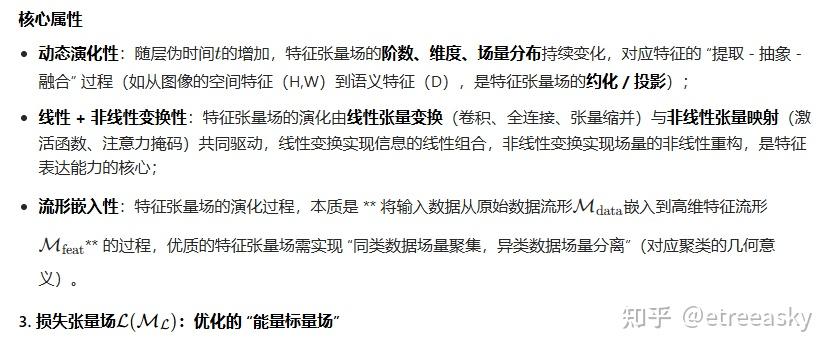

前向传播是特征张量场的动态演化与张量场变换,前向传播是深度学习中信息从输入到输出的传递过程,从张量场视角看,其本质是特征张量场以参数张量场为算子、沿层伪时间t的动态演化过程,每一层的操作都是特征张量场的一次变换,变换规则由参数张量场的场量分布决定。

特征张量场的演化方程将层伪时间t视为离散的演化参数,特征张量场的前向演化可表示为离散的张量场动力学方程:Φ(t+1)=T(Φ(t),Θ),其中T(⋅,⋅)为张量场变换算子,由网络层的操作决定,是参数张量场Θ与当前特征张量场Φ(t)的耦合函数。

不同网络层的变换算子,对应张量分析中的基本张量运算,实现特征张量场的线性重构与非线性演化。卷积层:张量的卷积积(线性变换),本质是特征张量场与参数张量场(卷积核)的张量缩并,实现场量的空间局部融合;全连接层:张量的矩阵乘法(线性变换),是特征张量场的全局缩并,实现场量的高维线性组合;激活函数(ReLU、Sigmoid、GELU):非线性张量映射,对特征张量场的每个场量分量做逐元素非线性变换,打破线性演化的局限性,实现特征张量场的非线性重构;池化层:张量的投影 / 约化,是特征张量场的维度压缩,保留场量的核心特征(如最大值、平均值),降低计算复杂度;注意力层:张量的加权缩并,是特征张量场的自适应融合,由注意力掩码(参数张量场子场)决定场量的融合权重,实现 “关键信息增强,无关信息抑制”。

前向传播过程可以被视为输入数据通过网络层的变换,形成动态演化的特征张量场,动态演化的特征张量场是输入数据的“张量流”之旅,这一过程可以形式化为特征张量场的连续变换:F^(l) = T^(l)(F^(l-1)),其中 F^(l) 是第 l 层的特征张量场,T^(l) 是由权重 W^(l) 和激活函数 φ 定义的变换算子。前向传播是输入数据 x 在参数 θ 确定的几何结构下,穿越一系列嵌套的特征空间的演化过程。每一层的输出 h^(l) 可以视为定义在网络深度维度 l 和空间/通道维度上的一个动态张量场。整个前向传播,就是这个张量场从简单的原始输入 x,随着深度 l 的增加,按照由 θ 决定的演化方程(即层间的复合函数)逐渐变形、复杂化的过程。特征张量场的动力学演化,前向传播过程可形式化为离散演化方程。从连续场论角度,当层宽趋于无穷且深度增加时,上述离散方程可连续化为偏微分方程。

端到端学习是张量场统一视角的直接体现,其本质是从输入到输出的“张量流”直接优化,张量场的“全局统一”与“自动特征学习”。特征张量场的“语义演化”,网络自动从数据中学习“低级→中级→高级”的特征表示,无需人工设计特征工程。这种“语义演化”是端到端学习的核心。端到端模型(如CNN、Transformer)将输入数据(如图像、文本)直接映射到输出结果(如分类标签、翻译文本),中间无需人工设计特征工程(如SIFT、HOG)。输入层输入数据转换为张量(如图像→3阶张量); 隐藏层通过张量运算(如卷积、自注意力)逐步提取特征(如3阶张量→3阶张量→…→1阶张量); 输出层输出结果(如分类标签→1阶张量)。 深度网络的前向传播类似于物理系统的粗粒化过程,而不同层捕捉的是数据在不同“尺度”上的有效描述。

网络是从输入流形到输出流形的非线性几何映射,每层对应纤维丛,层间映射是纤维丛结构映射,激活值在层间按张量场演化规律变换,网络具有丰富的内部规范对称性,网络表现出有序、混沌、临界等相行为,网络在输入流形上诱导非欧几何结构。这种张量场视角不仅提供了统一的理论框架,还为网络设计、优化算法和理论分析提供了新工具。深度学习可被视为一种离散微分几何的实现,其中前向传播是协变传输,反向传播是协变微分,训练是寻找最优几何结构的过程。通过这一视角,我们得以理解深度学习的"深度"不仅意味着层数多,更代表着几何结构的层次化和表示空间的纤维化,这正是其强大表达能力的几何根源。

三、能量最小场优化

损失函数作为场作用量,损失函数 L 是定义在参数场 W 上的泛函,可解释为场的作用量或能量。深度神经网络,其参数集合 θ = W^(1), W^(2), .........W^(L) 可以被视为定义在参数空间上的张量场,训练过程就是寻找参数空间中使损失函数最小的点,即寻找张量场的"能量最小点"。传统深度学习模型常被视为“特征提取+分类/回归”的模块拼接系统,各模块(如卷积层、全连接层)独立优化,误差易累积且全局最优性难以保证。高维张量场理论的引入为深度学习提供了整体一元的描述框架, 所有网络参数(权重、偏置)构成一个高维张量场,输入数据经各层变换形成动态演化的特征张量场; 整个网络成为一个协同优化的统一系统,而非孤立模块的叠加; 损失函数 L 定义了一个误差张量场,它量化了网络输出与真实标签之间的差异,误差张量场:E(θ) = L(f_θ(x), y),非凸、高维、具有多个局部最小值,在物理学类比中,优化过程即最小化该场的"能量",使系统达到稳定状态,优化过程即通过反向传播最小化该场的“能量”(即误差)。对于输入X和标签Y,能量函数E(W, X, Y)衡量“参数W下,X与Y的兼容性”(能量越小,兼容性越好)。损失函数是能量函数的正则化(如L(W, S) = 1/P Σ(L(Y_i, E(W, Y, X_i))) + R(W),其中R(W)是正则化项,防止过拟合)。基于能量的模型将损失函数视为能量场,优化过程即最小化能量。反向传播通过链式法则实现张量场的联合优化,避免局部最优。端到端学习从输入到输出的张量流直接优化,实现全局最优优化过程即最小化误差场“能量”,深度学习的目标是调整网络参数,使网络的预测尽可能接近真实结果。通过反向传播算法,计算误差张量场相对于网络参数的梯度,然后根据梯度信息更新参数。这个过程实际上是在最小化误差张量场的“能量”,也就是不断减小误差,使网络性能逐步提升,直到达到一个较优的状态。基于能量的模型(EBM)通过能量最小化优化网络,避免了概率模型的“归一化常数”问题(如GAN的判别器能量函数无需计算配分函数)。例如,DTF模型将张量分解与深度神经网络结合,预测抗癌药物协同作用,PR AUC达0.58,优于传统张量方法(0.24)。

通过张量分解(如CP分解、TT分解)可将高维参数张量简化为低秩结构,降低计算复杂度。例如,F-INR模型使用函数张量分解将隐式神经表示(INR)的[1000×2048×7×7]权重张量分解为[1000×r×r×r]的低秩张量(r是分解秩),训练速度提升100倍,同时保持高保真度。

【展望】

该范式的数学基础是张量分析与微分几何,物理基础是经典场论(如麦克斯韦电磁场、广义相对论的度规场、连续介质力学的变形张量场)与变分法(如哈密顿原理的能量最小化),实现了深度学习与数学物理底层框架的深度融合。用微分几何与经典场论的语言,将深度学习网络重构为高维流形上的张量场动力学系统,打破了传统 “分层独立分析” 的视角,把网络参数、特征演化、损失优化全部统一到张量场的定义、变换、变分与能量最小化框架中,本质是用数学物理的场论底层逻辑,刻画深度学习的整体运行与训练规律。这与经典场论(如电磁场、引力场、连续介质力学的变形场)具有高度的理论同构性。深度学习的 “训练” 对应场论的 “场量寻优”,“前向传播” 对应场的 “动态演化”,“反向传播” 对应场的 “变分微分与梯度流传播”,而所有网络组件与过程的核心载体都是张量场。这也契合深度学习的本质,以张量为基本数据单元,通过张量运算实现信息的提取、变换与优化,天然具备张量场的建模基础。

深度学习 = 高维流形上的张量场动力学一元系统

优化作为场方程求解,参数更新规则对应于场运动方程,这是梯度流方程的离散形式,类比于物理中的虚时演化或朗之万动力学。深度网络的训练动力学可用 平均场理论 描述,当宽度趋于无穷时,网络行为收敛到高斯过程。深度学习的这种动态场论视角,与理论物理中的路径积分、重整化群等思想产生了深刻的共鸣。深度学习与规范场论、广义相对论在数学结构上的深刻同构,数据驱动学习本质上是几何流的自组织临界现象。深度学习视为一个整体的张量场动态系统,为我们理解其内部运作、设计新架构、分析优化与泛化,提供了一个强大、统一且充满美感的数学语言。它揭示了网络训练的本质是在一个由架构决定的特定高维弯曲空间中,引导一个参数点沿着由数据定义的“能量地形”进行演化的几何过程。

未来,如果将深度学习与张量分析、微分几何、经典场论、变分法等数学物理底层框架深度融合,使深度学习能直接借鉴这些学科的成熟理论与工具:从场论中借鉴场的演化、变分、能量最小化理论,研究特征张量场的演化规律;从微分几何中借鉴流形的曲率、度量、测地线理论,设计更高效的黎曼梯度下降算法;从连续介质力学中借鉴变形张量场的理论,研究网络的 “变形能力” 与特征提取能力;从群论中借鉴群的对称性理论,研究张量场的对称性与网络的不变性(如卷积的平移不变性对应特征张量场的平移对称性)。借鉴规范场论、弦论和量子引力的数学工具,深度学习理论可能迎来类似物理学在20世纪的革命性突破。随着张量场理论的进一步完善,深度学习有望实现更高级的智能(如AGI)。张量场理论为通用人工智能(AGI)提供了统一的数学框架。 AGI多模态融合将图像、文本、语音等多模态数据转换为张量,通过张量运算实现融合(如CLIP模型的图像-文本对齐); 因果推理通过张量场的变化(如干预后的特征张量)推断因果关系(如 do-calculus的张量实现); 自主学习通过张量场的“自组织”(如Hebbian学习)实现无监督自主学习(如CompressARC模型的无预训练推理)。

目前的深度学习框架(PyTorch、TensorFlow)均基于 “分层张量运算” 设计,尚未支持整体张量场的全局运算。主要是因为整体参数张量场与特征张量场的阶数高、维度大,对其做全局微分、变分、几何分析的计算成本远高于传统的分层计算 ,这导致张量场视角的理论研究暂时难以直接落地到工程实践中。如果深度学习框架的张量场重构,设计支持整体张量场全局运算的深度学习框架,针对大模型的多模态特征,首先处理‘子同态场’的“子特征空间”,再延展‘子同态场之间相互作用’规律,建立多场耦合的张量场动力学方程,有望在经济成本允许情况下实现一体化张量场视角的工程化落地。

https://blog.sciencenet.cn/blog-1666470-1524885.html

上一篇:深度学习多隐层架构数理逻辑浅析(十八)(3)

下一篇:深度学习多隐层架构数理逻辑浅析(十八)(5)