博文

光学基础知识大讲堂 ——第7期:G20峰会演出上的全息技术

精选

精选

|

光学基础知识大讲堂

——第7期:G20峰会演出上的全息技术

这两天,杭州G20峰会吸引了全球的关注,而由著名导演张艺谋亲自执导的峰会文艺演出《最忆是杭州》也同样惊艳了世界。晚会节目中《天鹅湖》、《月光》、《我和我的祖国》等均采用了室外水上全息投影技术,尤其是《天鹅湖》,让我们看到了全息印象和真人表演“天人合一”的意境。那么,今天就让我们来解密下这“天人合一”的黑科技吧!首先,欣赏几张文艺演出时的精彩图片:

图1 G20峰会文艺演出(图片来源于网络)

图1中彩色屏风和LED桥都是带幕布的,而非全息显示方式,其中舞者从一个变多个是真正的全息显示技术。如果你看到上面的图片只是单纯地觉得漂亮,没有震撼到你,那么我们再来领略下里约奥运会闭幕式上“东京八分钟”的精彩表演。

图2 下一届东京奥运会宣传视频

全息原理

好,接下来进入正题,什么是全息技术?

全息技术利用的是干涉原理,干涉在前面几期也已经讲过多次,利用两束光(参考光和含有目标物体信息的物光)的干涉效应,可以记录物体的所有信息(光强和相位)。这也是全息区别于普通照相最重要的地方,普通成像只是记录了光强,并没有记录下物体的相位信息,所以成像的时候是二维平面的。而全息技术通过光的干涉,不仅记录了光的振幅,同时也一并记录了相位,通过干涉条纹的形式保存在全息底片上面。这是第一步,还有一步是图像再现:即成像过程。此过程利用的光的衍射原理,在相干光的照射下,通过全息底片可以呈现与原物体1:1大小、完全一样无失真的像。

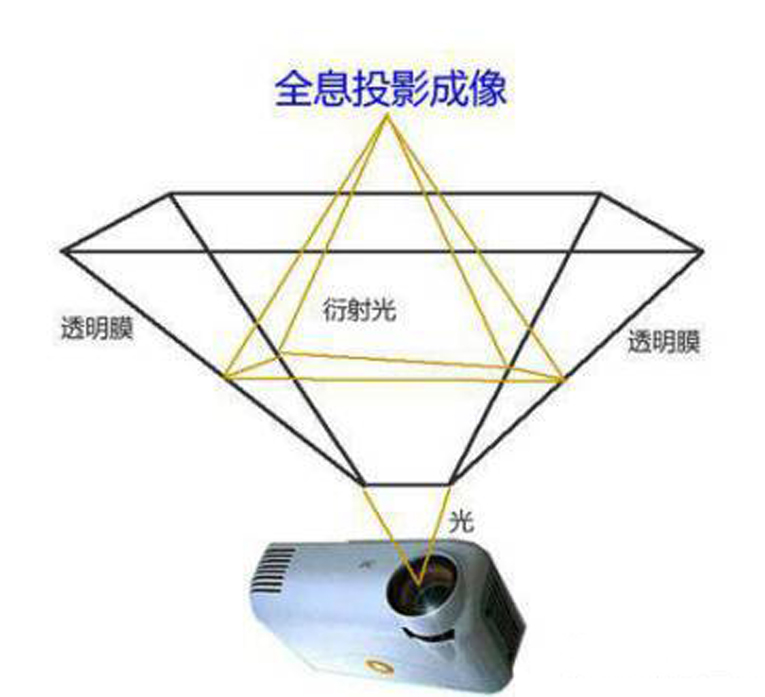

图3全息再现示意图(图片来源于网络)

注:全息显示不需要透明膜等其他元器件的支持,可直接成像

图4 类全息再现动态图(图片来源于网络)

注:感谢魏广路老师的指正,该图为3D虚拟成像,非全息显示图

全息术历史

全息技术最早由英国科学家Gabor于1948年提出,因此,他也在1971年被授予了诺贝尔物理学奖。初期,全息图成像质量非常差,直到1960年激光的发明,全息技术才蓬勃发展起来。全息技术大致可以分为四个阶段:

同轴全息术

从1948年Gabor发明全息技术到20世纪50年代末,全息光源一直采用汞灯,而且参考光和物光是同轴的,这直接导致全息成像时,1~4级衍射光波分不开,再现原始像和共轭像重叠,不仅如此,由于光源的相干性也非常差,导致全息技术发展非常缓慢。

离轴全息术

随着1960年激光的产生,大大解决了光源相干性的问题。而且,参考光和物光也采用了离轴模式,使得全息再现时的衍射级次在空间上分离开来,从而可以得到单独的再现图像(不再重叠)。解决了这两大难题之后,全息术也进入了一个非常活跃的阶段,被称为第二代全息技术。

白光再现全息术

由于激光器再现的全息图丢失了图像的色彩信息,这自然不是我们想要的,于是人们开始致力于研发第三代全息技术。第三代全息技术采用激光记录,白光再现的方式,在一定程度上大大丰富了全息再现图的色彩。

白光记录和白光再现全息术

可以预见,如果还有下一代全息术,相比于第三代激光记录,白光再现的方式,如果能够实现白光记录,白光再现的模式,那全息技术就可以真正地走出实验室,进入更广泛的应用领域。

VR眼镜和3D眼镜

正常情况下,这一节该谈谈全息术的应用了,但是忽然觉得没什么意思,无非最火的就是全息3D显示。所以,我们还是来聊聊近来同样很火的AR(增强现实)/VR(虚拟现实)技术。与全息显示技术一样,它可以生成3D效果(当然原理不同),不仅可以让你进入虚幻的世界,也可以把真实世界和虚拟图形完美地结合在一起。

图5 增强现实技术效果图(图片来源于网络)

VR技术是将虚拟信息环境通过计算机技术呈现在用户体验者面前,通过人机互动来改变不同的场景。AR技术是一种将真实世界和虚拟世界“无缝”集成的新技术,通过计算机把一些本不能让人类感知到的信息添加到实体信息中去。

那这类技术成3D像的原理是什么?VR技术其实是利用了人眼的视觉滞留效应。视觉滞留现象是指当人眼所看到的影像消失后,人眼仍能继续保留其影像0.1~0.5 s左右的图像。另外,由于人眼成像是左眼看到左侧,右眼看到右侧,然后大脑自动对比出两幅图像的差别,产生立体感!

图6 人眼成像原理图

图6是人眼成像的原理图,左眼看到M1,右眼看到的M2,那么人的大脑自动认为这个M点位置在A处;同理左眼看到M2,而右眼看到M1,那么我们会认为这么M点位置在A’处。举个栗子,如果你想在屏幕上看到一架飞机从你眼前飞过,方法就是,让你左眼看到飞机图像在M1点,右眼看到飞机图像在M2点,然后从M1点往M2点移动;右眼同理,让图像从M2点往M1点移动,这样自然就形成了飞机从A点往A’点移动,从而产生3D立体感。VR技术就是直接让你左眼看到虚拟图像1,让你右眼看到虚拟图像2,然后人眼自动合成3D虚拟图像,这就是3D成像的原理。

讲到这里,我又想到了另外一种眼镜,3D眼镜,也就是我们去电影院看3D电影经常戴的眼镜。其实原理是一样的,只不过它需要处理的是从屏幕上图像发光问题,因为它不是像VR眼镜那样直接把图像信息分别发送到眼镜的左右镜片上。那如何做到?前面提到,人眼具有视觉滞留效应,所以直接将影片做成一会儿只让左眼接收到,一会儿只让右眼接收到,那么自然就让人脑自动识别成立体图像了。那如何又让图像“只”让一只眼睛看到呢?举一个最简单的例子,利用光学的偏振原理(上一期也提到过)就可以,让3D眼镜左右镜片分别做成垂直方向偏振和水平方向偏振的偏振片,相应地让图像发出的光也具有相同的偏振性,那么自然就能让不同的眼睛只看到我们想让他看到的图像,屏蔽掉另外一幅图像,从而形成立体感,这也是为什么摘掉眼镜直接看你会觉得图像模糊的原因!

https://blog.sciencenet.cn/blog-3214791-1001453.html

上一篇:光学基础知识大讲堂 ——第6期:如何提高激光的功率?

下一篇:光学基础知识大讲堂 ——第8期:光的散射

全部作者的精选博文

全部作者的其他最新博文

全部精选博文导读

相关博文

- • 700年后日本或濒临灭绝?日本学者推算预测:届时或仅剩1名15岁以下孩子

- • [转载]【同位素视角】非英语母语学者如何区分’e.g.’, ‘i.e.’, ‘namely’与‘such as’等混淆难题

- • 美国佐治亚大学等机构学者:刈割策略对Bulldog 805紫花苜蓿+Tifton 85狗牙根混播草地产量及品质的影响

- • 美国堪萨斯州立大学、密苏里大学等机构学者研究成果:土壤水分管理策略和品种多样性对紫花苜蓿产量、营养品质和农场盈利能力的影

- • 德国、捷克草业科学学者长期放牧实验:异质草地斑块中的土壤有机碳储量和地下生物量

- • 如何才能连续被评为十年“中国高被引学者”?——对话上海大学王卿文教授