博文

“养龙虾”需求暴增撞上“内存墙”,AI 能耗焦虑有解了?普渡大学这项研究带来新思路  精选

精选

||

写在前面:"养龙虾"狂飙突进,AI 算力遭遇能源焦虑

2026 年开春,一场由开源 AI 智能体 OpenClaw 引爆的"养龙虾"热潮从极客圈急速蔓延至中国的大街小巷。

因其能够"替人干活"——自主操控浏览器、读写文件、管理日程甚至执行跨应用任务——迅速成为全民追逐的

科技新宠。点此可免费阅读&下载原文

而当越来越多用户开始期待 AI 不只会聊天,还能在电脑、手机、无人机或各类终端设备上长期在线、实时响应、

自主执行任务时,然而,一个严峻的现实正在浮现:AI 算力的能源消耗正以前所未有的速度攀升。

据 IDC 预测,到 2030 年,全球活跃 AI 智能体将达 22.16 亿,年度 Token 消耗量将从 2025 年的 0.0005 Peta

Tokens 飙升至 15.2 万 Peta Tokens,增长超 3 亿倍。英伟达创始人黄仁勋多次警示:"电力掐住了 AI 的咽喉",

马斯克更直言,未来几年全球将面临"有芯片却无法开启"的局面。AI能耗已成为制约技术落地的"阿喀琉斯之踵"。

在这一背景下,来自普渡大学和佐治亚理工学院的研究团在 Frontiers in Science 发表的最新研究,为破解 AI 能

耗困境提供了全新思路。该研究直指传统计算机架构的核心瓶颈——"内存墙",并提出借鉴人脑高效处理机制的

硬件设计方案,有望在不依赖高能耗云计算的前提下,让 AI 应用真正走出数据中心,融入无人机、医疗设备、

智能终端等现实场景。

&utm_medium=social&utm_content=BTMW&utm_campaign=fscipromochn

“内存墙”为什么会拖慢 AI,也推高能耗?

传统计算机建立在冯·诺依曼架构之上:处理器负责计算,存储器负责保存数据,二者彼此分离。这样一来,

每当系统需要调用数据时,信息都必须在这两个组件之间来回传输。研究人员指出,这种传输过程即所谓的“内

存墙”(memory wall)——这种数据往返不仅带来延迟,也消耗了大量能量。这正是许多 AI 硬件效率瓶颈的根

源之一。

研究团队认为,如果能够将处理能力直接集成到存储单元内部,或部署在其邻近位置,就有望突破这一瓶颈。

实现这一点后,将可能催生新型算法,使 AI 应用无需过度依赖数据量庞大、能耗高昂的云端计算,也能具备实

际可行性。

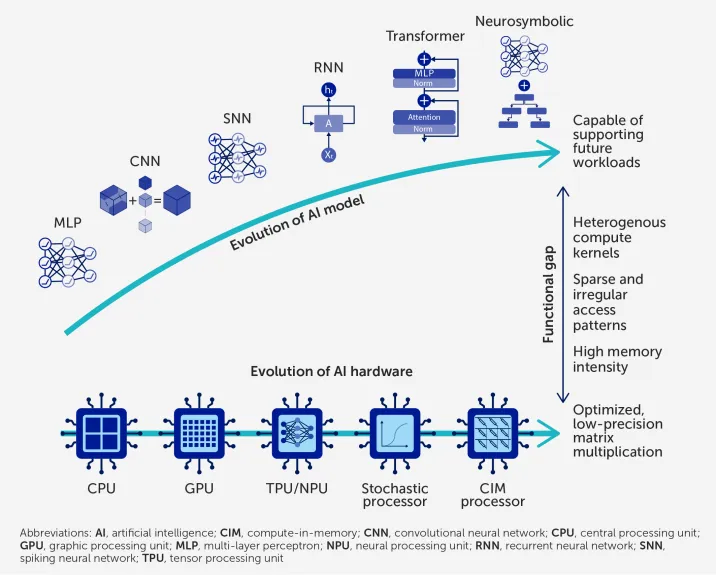

随时间演进的人工智能(AI)模型和硬件。随着 AI 工作负载复杂性和需求不断增加,AI 模型也在体积和复杂度

上扩展以维持性能,导致实现高能量和高延迟。

该研究的第一作者、普渡大学电子与计算机工程教授 Kaushik Roy 表示:“在过去四年里,语言处理模型的规模

增长了 5000 倍。如此惊人的扩张速度意味着硬件若继续沿用旧有思路,能耗压力只会进一步上升,我们必须尽

可能提升 AI 的效率。这意味着,我们需要从根本上重新思考计算机的设计方式。”

为什么研究人员开始重新向人脑学习?

避免“内存墙”问题、提升 AI 计算效率的一种途径,是从人脑中获取灵感。当神经元接收到来自其他神经元的

激活信号时,它会累积电荷,即膜电位。如果这个电位达到某个阈值,神经元就会继续发送自己的信号。也就是

说,神经元能够在同一位置同时完成信息的存储与处理,并且只有在状态发生变化时才进行通信。

这一机制启发了新一类 AI 算法——脉冲神经网络(spiking neural networks, SNNs)。这类网络能够高效响应不

规则和偶发的事件。相比之下,传统 AI 网络更擅长处理数据密集型任务,例如人脸识别、图像分类、图像分析

以及三维重建。

该研究共同作者、普渡大学研究人员 Adarsh Kosta 表示:“长期以来,人脑的能力一直是 AI 系统的重要灵感来

源。机器学习算法就源于大脑从输入数据中学习并进行泛化的能力。如今,我们希望更进一步,复现人脑高效的

信息处理机制。”

从“会算”到“能在端上算”:现实应用的关键差别

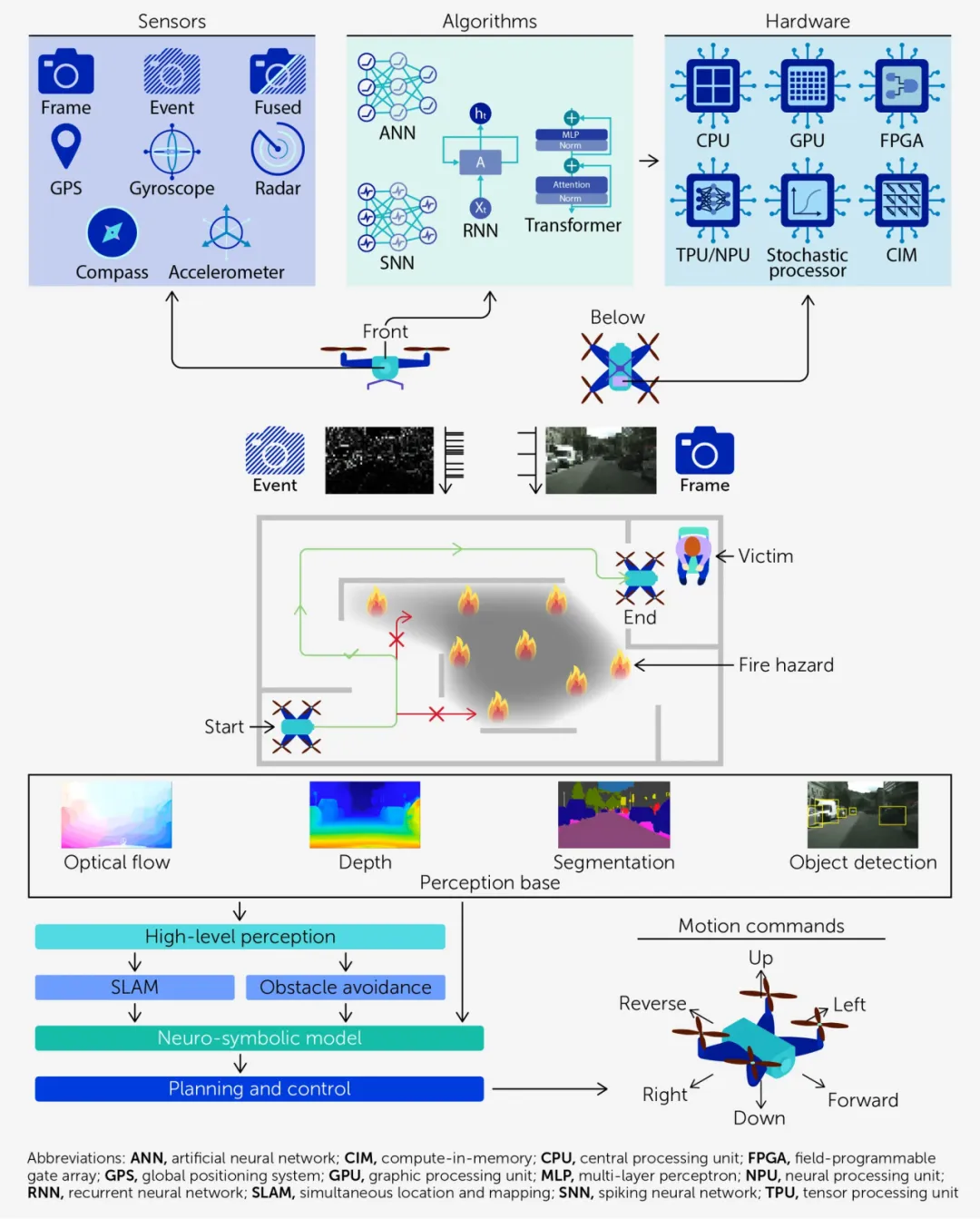

这种受神经科学启发的路径,可能使 AI 应用突破大型数据中心的限制,走向更广泛的现实场景。例如,在搜救

任务中执行自主飞行的无人机,需要实时感知环境、识别并跟踪目标、做出决策,并规划后续行动。如果依赖云

端计算,时延往往过高,因此这些任务必须尽可能高效地在机载设备上完成。

在这类场景中,计算系统必须具备轻量化、低功耗的特点。提升效率的一种方式,是让无人机采用基于事件相机

(event-based cameras)。与记录连续帧的传统视频相机不同,这类传感器只有在像素变化达到一定程度时才

输出数据。

基于事件相机能够显著降低数据量和功耗;但与此同时,其输出具有间歇性和时间依赖性,并不适合由传统处

理单元高效处理。而脉冲神经网络算法与人脑类似,能高效响应事件序列,能够充分利用这类稀疏信号。

一个典型应用:涉及无人机(UAV)执行的搜救任务。

这种方法有望让无人机具备更强的能力,或实现更远的续航距离。更高的能效同样会使交通运输、医疗设备等

众多领域的 AI 应用受益。该研究共同作者、普渡大学研究人员 Tanvi Sharma 表示:“AI 是 21 世纪最具变革性

的技术之一。然而,要将其从数据中心推向现实世界,我们就必须大幅降低其能耗。通过减少数据传输、提高

处理效率,AI 才能融入小型、价格合理、电池续航更长的设备中。”

真正的关键,在硬件而不只在算法

不过,研究也明确指出:仅有受脑启发的算法还不够,想真正发挥 SNN 等方法的优势,还需要能够克服"内存墙"

的专用硬件。被重点讨论的方向是"存内计算"系统(compute-in-memory, CIM),即能够在数据存储的位置直接

执行计算,从而减少高代价的数据搬运。这一点尤其适合 SNN,因为 SNN 需要反复访问存储单元,以便随时间

更新并检查膜电位状态。

实现 CIM 主要有两种路径:

- 模拟方法(analog):利用流经存储单元的电流直接执行计算;

- 数字方法(digital):在存储阵列内部或其邻近区域使用标准数字逻辑(0 和 1)完成运算。

其中,数字方法精度更高,但其能耗通常也高于模拟方法。

这项研究真正提供的,不是“捷径”,而是路线图。

因此,更准确地说,这项工作并不是宣布 AI 能耗问题已经被解决,而是提出了一条更具可持续性的技术路线:

将算法、芯片架构、电路设计与存储器件协同设计。

Roy 总结道:“只有将硬件与算法进行协同设计,我们才有可能真正突破内存墙,实现快速、轻量、低功耗的 AI。

这种协同设计方法还有望构建出更具通用性的计算平台,使系统能够根据具体应用场景,在传统 AI 网络与受脑启

发的神经网络之间灵活切换。”回到当下“养龙虾”热潮所折射出的现实需求,人们真正期待的并不只是一个更会

回答问题的 AI,而是一个能在本地稳定运行、能持续执行任务、又不会迅速耗尽算力与电力预算的 AI。也正因如

此,OpenClaw 这样的现象级应用虽然是由智能体热潮点燃,但它背后暴露出的,实际上是整个 AI 产业更深层的

共同问题:当 AI 要真正走出数据中心,硬件必须先学会更像大脑那样工作。点此可免费阅读&下载原文

关于 Frontiers in Science

Frontiers in Science是 Frontiers 最新全力打造的一本旗舰期刊,于 2023 年 2 月 28 日正式发布。期刊以邀请制的方式发表经同行评

审的、具有杰出影响力学者的最新变革性研究,已汇聚全球 90 多个国家的科研力量。期刊致力于推动跨学科、

具有政策影响力的前沿科学研究以实现“健康星球上的愉悦生活”目标 ,目前已发表的文章累计阅读超 380 万次。

了解期刊详情请访问期刊官网:http://www.frontiersin.org/journals/science

如希望报导更多关于 Frontiers in Science 的相关内容,欢迎通过邮件说明意图发送至

marketing.china@frontiersin.org

https://blog.sciencenet.cn/blog-3465500-1527503.html

上一篇:直播预约 | Frontiers 科研诚信系列公开课第二讲

下一篇:直播回顾 | Frontiers 科研诚信系列公开第二讲