博文

基于视觉属性的多模态可解释图像分类方法

|

引用本文

王辉, 黄宇廷, 夏玉婷, 范自柱, 罗国亮, 杨辉. 基于视觉属性的多模态可解释图像分类方法. 自动化学报, 2025, 51(2): 445−456 doi: 10.16383/j.aas.c240218

Wang Hui, Huang Yu-Ting, Xia Yu-Ting, Fan Zi-Zhu, Luo Guo-Liang, Yang Hui. Multimodal interpretable image classification method based on visual attributes. Acta Automatica Sinica, 2025, 51(2): 445−456 doi: 10.16383/j.aas.c240218

http://www.aas.net.cn/cn/article/doi/10.16383/j.aas.c240218

关键词

可解释性,视觉属性,多模态融合,决策树,图像分类

摘要

基于深度神经网络(Deep neutral networks, DNN)的分类方法因缺乏可解释性, 导致在金融、医疗、法律等关键领域难以获得完全信任, 极大限制了其应用. 现有多数研究主要关注单模态数据的可解释性, 多模态数据的可解释性方面仍存在挑战. 为解决这一问题, 提出一种基于视觉属性的多模态可解释图像分类方法, 该方法将可见光和深度图等不同视觉模态提取的属性融入模型的训练过程, 不仅能通过视觉属性和决策树对已有的神经网络黑盒模型进行解释, 而且能在训练过程中进一步提升模型解释信息的能力. 引入可解释性通常会造成模型精度的降低, 该方法在保持模型具有良好可解释性的同时, 仍具有较高的分类精度, 在NYUDv2、SUN RGB-D和RGB-NIR三个数据集上, 相比于单模态可解释方法, 该模型准确率明显提升, 并达到与多模态不可解释模型相媲美的性能.

文章导读

深度神经网络(Deep neutral networks, DNN)由于其出色性能而在计算机视觉分类等任务中得到广泛运用[1−2], 然而, 其多层网络架构拟合复杂、非线性特征空间的特点致使其模型通常包含数亿个权重参数, 导致人们难以追踪、理解网络的决策过程[3]. 这种黑盒模型在需要高透明和高可信的领域(如医学、法律和金融等)难以应用, 因为它可能会以错误的结果误导用户, 甚至可能危害生命安全[4]. 相比之下, 一些经典的白盒模型如决策树[5]、规则学习[6]和贝叶斯网络[7]分别使用层次结构、推理规则和概率分布来展示推理过程, 然而这些白盒模型的预测精度远远低于深度神经网络. 研究人员尝试使用多种方法来解释黑盒模型, 例如基于梯度的可视化方法[8−9]、类激活图[10−11]、通过白盒模型创建代理局部拟合黑盒模型[12−13]或原型学习[14−15]等. 然而, 这些解释黑盒模型的方法并不直接参与到模型训练中, 因此不能提高模型提供解释信息的能力. 随着人工智能模型对可解释性的要求不断提高, 模型需要在保持高精度的同时实现良好的可解释性.

神经网络最初模仿大脑的神经元进行设计, 而在分类任务中, 即使面对未知的物体, 人类也可以做出预测并说明理由. 人类在认知物体过程中通过其所具有的视觉属性进行识别[16], 并借助触觉、听觉和味觉等多种模态信息帮助做出更精确的判断. 医学研究结果证实, 多感官的整体感知效果大于各感官的独立感知效果[17], 多模态数据的综合信息对于准确理解和认知物体至关重要. 具体而言, 人类通过多个感官感知物体所具有的属性, 并从已有知识中找到具有相同属性的类别原型. 例如, 铁门通常看上去很坚固, 摸起来冰凉光滑, 开关门时会发出低沉的声音, 这些属性就是铁门的原型. 当人类不知道一种门的材质时, 仍然可以根据它与铁门相同的属性来做出判断.

同时, 类别原型中天然存在一定的层次结构, 类似于图1所示的生物分类学. 每个类别都继承其父类的所有属性, 但又有其独特的部分. 例如食肉目和兔形目同属哺乳纲, 都继承哺乳纲有四肢、有耳廓的生理特征, 又存在食肉目眼睛前置, 兔形目眼睛在头部两侧的区别. 这种人类认知物体的方式启发我们可提取多模态数据的属性作为解释信息, 并使用决策树推理将这种层次结构加以利用. 通过提取和利用这些属性, 可以更好地理解和解释模型的决策过程, 使得模型在可解释性和精度方面取得更好的平衡.

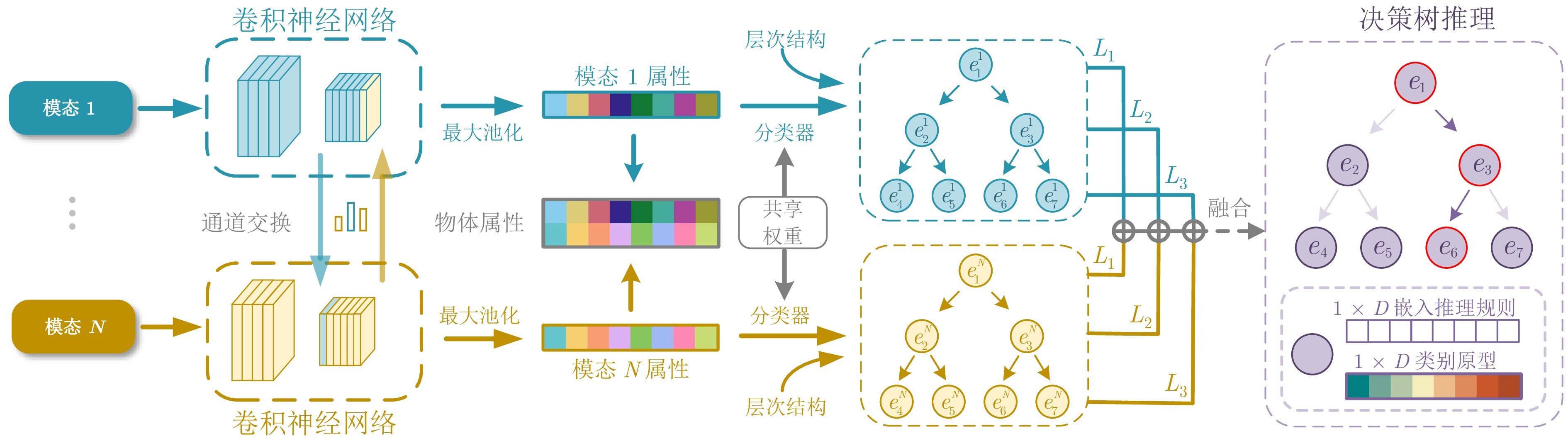

图 1 以生理特征为依据的生物分类学

多模态融合方法已经广泛应用于各领域中[18−19], 然而这些方法通常缺乏可解释性. 研究表明卷积神经网络(Convolutional neural networks, CNN)在分类任务中具有学习视觉属性的能力, 因此不再需要人工定义属性以建模物体[20]. 受这些工作的启发, 本文提出一种基于可见光、深度图等多模态图像输入的视觉属性可解释分类方法, 通过骨干网络在原型约束下学习输入数据的属性, 在预先设定的层次结构中进行树推理. 每个属性用一组具有相同特征的图像集合表示, 利用梯度加权类激活映射(Gradient-weighted class activation mapping, Grad-CAM)[21]可视化后归纳集合具有的特征.

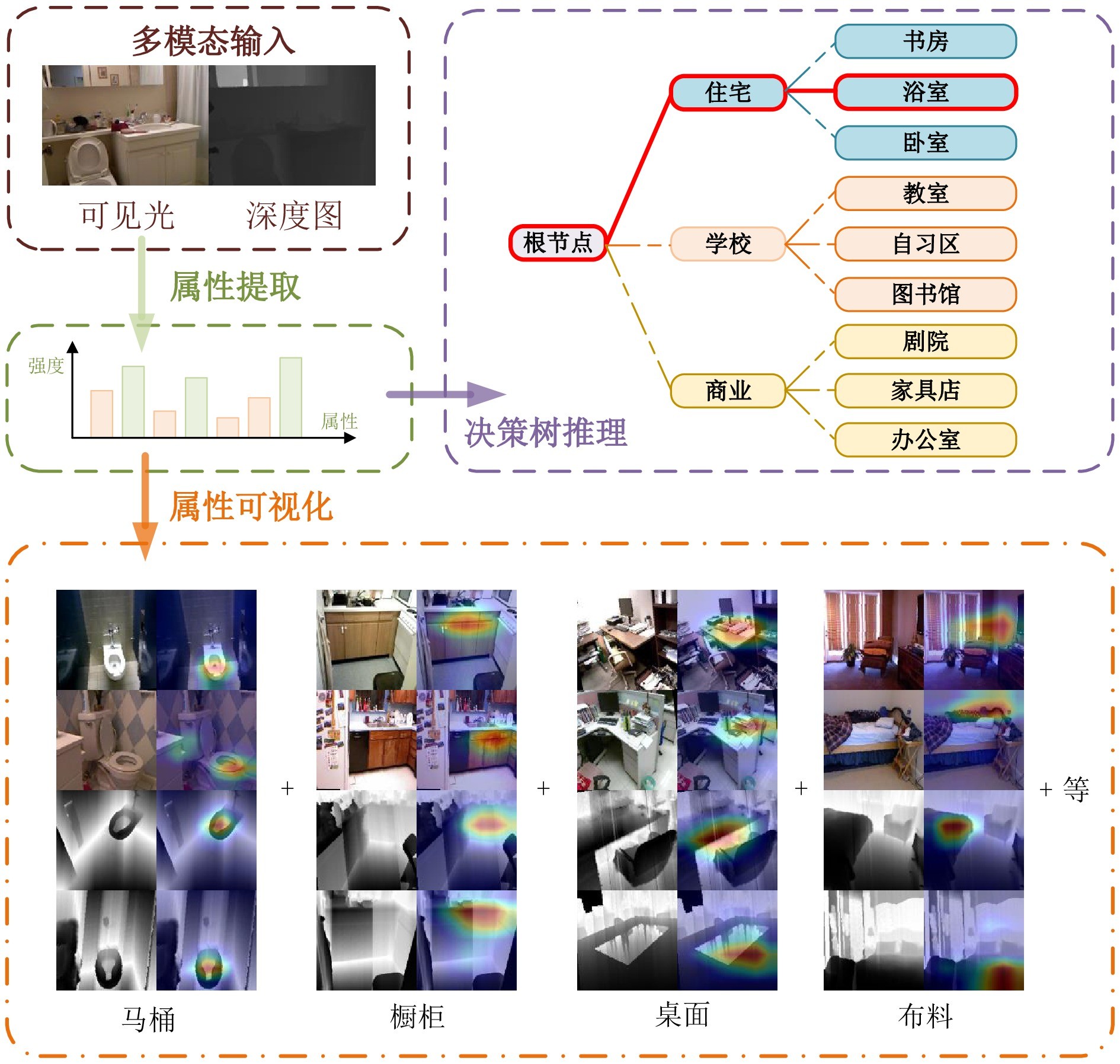

该方法流程如图2 所示, 提供属性集合和决策树推理过程对模型决策进行解释. 以一组浴室场景图像为例, 骨干网络计算可见光、深度图中具有的属性强度, 将该浴室场景表示为马桶、橱柜、桌面、布料等视觉属性的集合. 同时, 决策树依据属性强度进行推理, 认为这些属性首先符合住宅的特点, 进一步符合住宅中浴室的特点, 最终完成分类.

图 2 本文提出模型的推理流程

本文的主要贡献是:

1) 提出一种基于属性的多模态可解释分类方法, 该方法能够使用输入数据所具有的属性信息和决策树推理来解释分类结果, 并通过消融实验研究模型每个部分对整体性能的影响.

2) 提出一种面向多模态数据的决策树逐层融合方法, 实现在决策树推理阶段的证据融合, 在保证模型可解释性的同时提升准确性.

3) 本文的方法在准确性和可解释性方面都表现出色, 在三个多模态场景分类数据集NYUDv2、SUN RGB-D和RGB-NIR中达到最先进的性能, 并通过插入/删除测试验证了方法的可解释性.

图 3 可解释图像分类框架

本文提出一种基于属性的多模态可解释分类方法. 通过使用骨干网络提取属性、构建和融合决策树并利用决策树进行推理, 该方法具有良好的可解释性, 能够可视化地展示输入数据所具有的属性以及决策树的推理过程. 同时, 与其他单模态可解释方法和多模态不可解释方法相比, 我们的方法均表现出优秀的性能. 本文方法是解决多模态融合可解释性问题的一个良好尝试, 在保持较高准确率的同时, 还能提供清晰的解释信息, 帮助人们理解模型的决策过程.

作者简介

王辉

华东交通大学信息与软件工程学院副教授. 主要研究方向为人工智能, 计算机视觉. E-mail: huiwangens@163.com

黄宇廷

浙江大学软件学院硕士研究生. 主要研究方向为自然语言处理, 可解释人工智能. E-mail: yutinghuang@zju.edu.cn

夏玉婷

华东交通大学信息与软件工程学院硕士研究生. 主要研究方向为计算机视觉, 多模态图像融合. E-mail: xiayuting0403@126.com

范自柱

上海电力大学计算机科学与技术学院教授. 主要研究方向为模式识别与机器学习. 本文通信作者. E-mail: zzfan3@163.com

罗国亮

华东交通大学信息与软件工程学院教授. 主要研究方向为计算机视觉, 人工智能. E-mail: luoguoliang@ecjtu.edu.cn

杨辉

轨道交通基础设施性能监测与保障国家重点实验室教授. 主要研究方向为复杂系统建模, 控制与运行优化. E-mail: yhshuo@263.com

https://blog.sciencenet.cn/blog-3291369-1480077.html

上一篇:基于视觉的人体动作质量评价研究综述

下一篇:AP-IS: 面向多模态数据的智能高效索引选择模型