博文

我们不知道答案的125个科学问题(94)机器学习  精选

精选

||

94. 机器学习的极限是什么?

What are the limits of learning by machines?

题记:计算机已经可以打败世界上最顶级的专业棋手,而且它们可以非常高效地利用网络上丰富的信息和资源在各个专业领域不断超越人类。然而和人类相比,抽象推理能力目前仍然是任何一种机器学习系统都无法超越的能力。

一个人在出生以后,大脑中的神经元网络就开始处理感官输入的各种信息和数据,并逐渐在学习中建立起神经元的链接结构和响应回路,从而最终成长为一个具有认知、语言、思维、运动、情感和个性的人。而机器学习就是模仿人类学习成长的过程而开发的一种人工智能系统,它的核心就是使用可以处理输入数据的网络算法,从而通过统计分析做出预测和决策,并最终具备一定的自动处理事务的能力。按照人类学习成长的原理,一个机器学习系统学习的时间越长或训练地越久,它的“智力”就应该越强,而其在学习中所形成的网络算法结构和人类大脑也基本类似,我们并不清楚这个网络中具体的微观结构是什么,又是如何响应的,但它却能给出有效和准确的决策或判断。面对这样一个机器学习系统,我们的问题是:它学习成长的极限是什么?人类会不会通过一个足够强大的机器网络系统让它通过不断学习成长为一个达到或超越人类智力的机器,甚至可以具有人类的思维和情感而成为一个有意识的硅基生命?

图1 具有人类仿生智慧的机器人Ameca

这是机器学习一个恐怖的技术趋势,而且它正在一步步逼近这个目标。所以我们能不能从科学原理上给机器学习一个极限判定,从而明确机器智能系统最后能达到的最高水平。虽然目前看来机器系统的智力水平还远不能全面超越人类,但它的上限到底在哪里,这个问题的答案对人类而言至关重要,因为这将决定人工智能在人类生活中的地位是主导还是辅助。

从目前机器学习在各个领域的发展现状来看,机器学习在某些专业领域已经确信超越人类(如围棋完胜人类),而且机器学习本身就具有超越人类的系统优势:(1) 数据处理能力。机器学习对数据的搜集、整理、记忆和利用能力(数据挖掘能力)无论从速度和规模上都远超人类大脑(人类记忆力有限而且会遗忘);(2) 持续改进能力。机器学习可以24小时不间断地通过学习提高特定机器系统的性能,其迭代和进化的速度远超人类;(3) 标准自动化适应能力。对不同专业或行业都可使用特定地机器学习系统进行处理,系统之间可以通过管理机器学习系统非常准确地组织和配合,没有情绪、没有罢工也没有矛盾,只要系统规模足够,可以实现任何行业标准的自动化处理能力。

图2 AI人工智能全面战胜人类棋手

然而任何事物都有相互矛盾的两个方面,目前来看机器学习被认为具有以下缺点或局限性:

(1) 错误自检能力。机器学习第一个显著缺陷就是它对错误的敏感性(给香蕉贴上一个小标签就无法识别),而且当他们出现错误时(比如亚马逊简历筛选机器人出现的性别歧视问题,微软的聊天机器人满嘴飙脏话问题),它们自我诊断并纠正错误存在系统性困难,因为这将要涉及底层的算法和相关处理流程,具有系统不可处理的复杂度。这个问题其实也是机器学习系统底层逻辑的可塑性问题(有些是体系的基本架构,机器学习是无法修改的),而人类神经网络的可塑性却几乎具有无限的潜力。

(2) 继承性局限。机器学习系统的训练学习过程所得到网络的能力无法被其他系统继承,也就是一个新的系统必须要重新进行学习和训练才能使用,这无疑浪费了时间。虽然人类也是如此,一个新生命诞生后依然需要进行小学、中学到大学的学习训练才能成才,但人类教育的先进显然具有传承性(知识更新),但机器学习目前不具备此方面的能力,比如一个系统训练另一个系统让它快速成长或掌握更多知识的能力目前还不如人类。

(3) 预测性局限和验证问题。机器学习系统缺乏变通性(通用性或联想力差,面对一个新任务,哪怕是一个类似的场景,机器学习旧的算法参数就会失效,必须重新训练,现在为克服这个问题发展所谓的通用人工智能AGI),因为它仅仅是通过确定的大量历史数据来预测特定的结果,所以它的能力决定于历史数据的质量(比如会出现:garbage in garbage out),它只解决问题而没有提出问题的能力(不能创造数学或算法),也就是创造性差;虽然机器学习可以有新的预测,但在没有历史数据支持的情况下,很难完全肯定地证明机器学习系统的预测是正确的并适用于其他场景。一句话其通用能力(证明、推理)和创造能力依然不如人类。

图3 人工智能的神经网络

正因为存在以上的缺陷,有人认为机器学习是贪婪(需要大量的训练数据,给它1万张牛的照片它才能识别牛,而给孩子几张就够了)、脆弱(不能有一点点变通,能拿起一个杯子,拿不起一个瓶子)、不透明(它是一个黑匣子,输出无法解释)和肤浅(仅仅凭经验数据进行预测,没有先天知识和对这个世界和心理对错的基本常识,比如没有基本的因果关系,不能理解整体由部分组成,世界的空间和时间概念,没有你我的心理区分和道德基本标准,以至于无法真正理解自然语言等等,而且没有创造真正新的东西)的机器。

然而以上所说的优点和缺点并非能给机器学习的上限给一个原理性的界定,显然机器学习的优点完全可以不断放大,而缺点也不是不能被克服,这也是机器学习不断向前发展的方向,很难说这些限制或缺陷不会被最终解决,所以这个问题依然存在。为了清晰了解机器学习的潜力限制,我们必须对机器学习进行更为细致的了解和解剖,因为机器学习系统的优势或局限性取决于它为特定目的而开发的方式,历史数据的质量和处理数据的系统规模等等因素。

1. 机器学习简介

机器学习是一种人工智能,根据数据学习从而准确预测结果。机器学习的用途包括:推荐引擎、恶意软件威胁检测、欺诈检测、垃圾邮件过滤、识别预测自动化和业务流程自动化等。目前一些大规模使用机器学习的公司有:比亚迪、优步、特斯拉、百度、抖音、Facebook、谷歌、淘宝、华为等等,这些公司使用机器学习来完成人工智能的某一个方面,比如Facebook、抖音、淘宝等网站使用推荐引擎为客户推荐个性化内容,也就是如果一个用户在浏览抖音或淘宝时,停下来看某个视频或内容时,推荐引擎就会搜集数据进行输入,并开始推荐类似的视频和内容给用户;另外有很多网站公司都在使用内容检测机器学习系统,可以根据内容自动识别违规内容、恶意软件、欺诈网站或垃圾邮件等等,并自动进行处理,也就是网络机器人;另外就是工作方面的虚拟智能助手,如著名的处理文字图形的ChatGPT系列、AI办公助手、虚拟主播、智能翻译系统、AI医疗诊治系统、AI法律咨询系统等,这些虚拟助手通常结合无监督学习或监督学习的机器学习模型(具体介绍见后面)来提供文字服务和自然语音以及自动完成文本、图形处理及预测任务;最后就是机器学习和特殊硬件系统结合提供专业服务,比如目前很火的自动驾驶萝卜快跑,汽车驾驶系统使用基于机器学习模型的算法来进行自动驾驶;简单的如人脸识别分析系统,复杂的如蛋白质折叠预测、DNA代码序列分析检测,AI智能化学实验系统以及马斯克的家庭服务机器人等等(见图4所示)。

图4 机器学习在各个人工智能领域的应用

2. 机器学习分类及相关算法

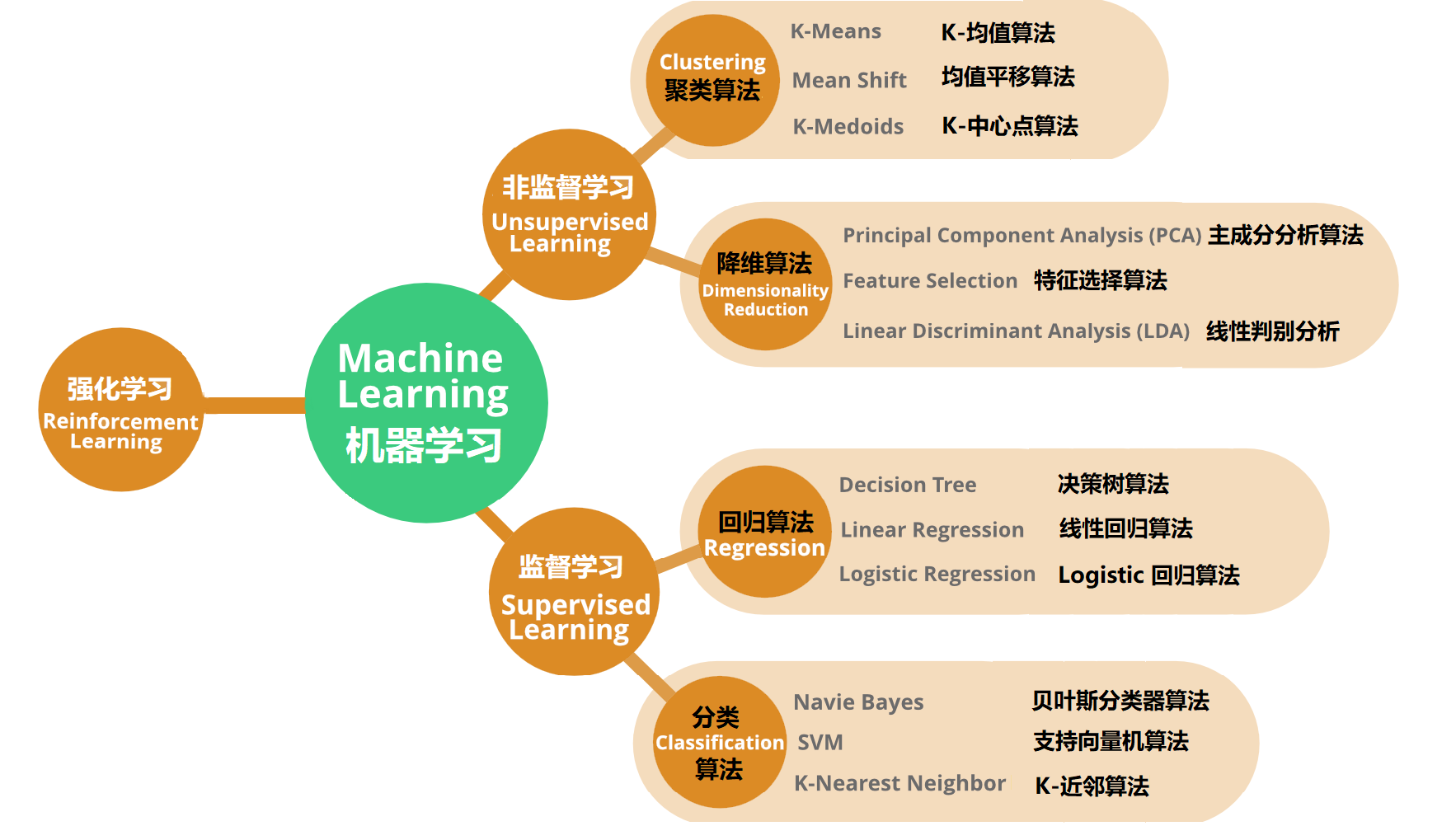

机器学习系统结构上非常简单就是:输入数据、网络训练和输出数据。根据机器学习的工作方式其可分为监督学习(Supervised Machine Learning)、无监督学习(Unsupervised Machine Learning )和强化学习(Reinforcement Machine Learning )三大类型(见图5所示)。监督学习的输入数据是具有标签(正确答案)的数据集合,它用来识别输入的数据结构并给出组预测或分类(分类方式)。直白了就是有老师监督下的学习,该算法是学生从训练数据集中学习,并做出预测,由老师的答案进行纠正,学习过程一直持续到算法达到所需的水平;而无监督学习使用无标签的数据进行训练,它通常使用一组输入变量来预测输出变量的值(映射方式),直白的说就是没有老师监督和答案标准,对应算法是不受监督地寻找数据中的底层结构,以便越来越多地了解数据本身。由此,这两类机器学习采用不同算法:无监督学习最常使用K-均值(K-means)或聚类(Clustering)的算法类型。它在识别数据结构时非常有用,在某些情况下,如果很难理解数据的某种趋势,无监督学习可以提供一种适当的数据模式帮助获得更好的数据理解;无监督学习是目前使用最广泛的机器学习算法,也是最常见的机器学习类型。它也被称为归纳学习,包括分类和回归两种目标,分类是指要预测的变量是分类的,回归是指要预测的变量是数值的;最后一种强化机器学习则是学生在自己的错误中进行学习的反馈过程,该算法通过试错来不断调整学习以达到最佳的行为或目标。

图5 机器学习分类及相应的算法

这三种机器学习模式都需要通过算法(Algorithm)来实现,下面介绍几种重要的算法:(1) 贝叶斯分类器算法。该算法基于贝叶斯概率定理进行分类,比如Gmail邮件系统的垃圾邮件过滤,它就使用该算法将电子邮件分类为垃圾邮件或非垃圾邮件;(2) K均值聚类算法。算法一般使用K个聚类(相关度)对给定的数据集进行操作并输出K个簇,如搜索引擎中根据关键词的网页分类;(3)支持向量机算法(SVM)。主要用于分类或回归问题;(4) 先验算法。一种概率关联预测,如果事件A发生,那事件B也会以一定的概率发生,比如文字推荐,当你输入一个单词时它会查找该单词之后相关单词的输入概率排列;(5) 线性和Logistic回归算法。线性回归算法预测连续自变量和因变量之间的概率关系,比如保险领域的风险评估,而Logistic回归算法处理离散值的预测概率问题;(6) 决策树算法。通过完成一件任务每一个方面或步骤(分支)的是与否(决策)来决定最后的结果。(7) 随机森林算法。为解决了决策树算法的局限性:当树中的决策数量增加时,结果的准确性会降低。随机森林算法中设定多个决策树代表不同的统计概率,通过搜索所有决策树的结果,得到随机森林算法的最终预测结果。比如汽车工业中预测特定汽车部件的未来故障;(8) K近邻算法。根据相关度量(如距离函数)将数据点划分为不同的类,然后在整个数据集中搜索K个最相近的实例(邻居)并总结这K个实例的输出变量,对新的数据点进行预测;(9) 人工神经网络算法。模拟人类大脑神经元网络,通过创建相互连接的神经元节点来接收信息,执行操作将信息作为输出传递给另一个神经元,比如人脸识别系统。

3. 深度机器学习及其极限

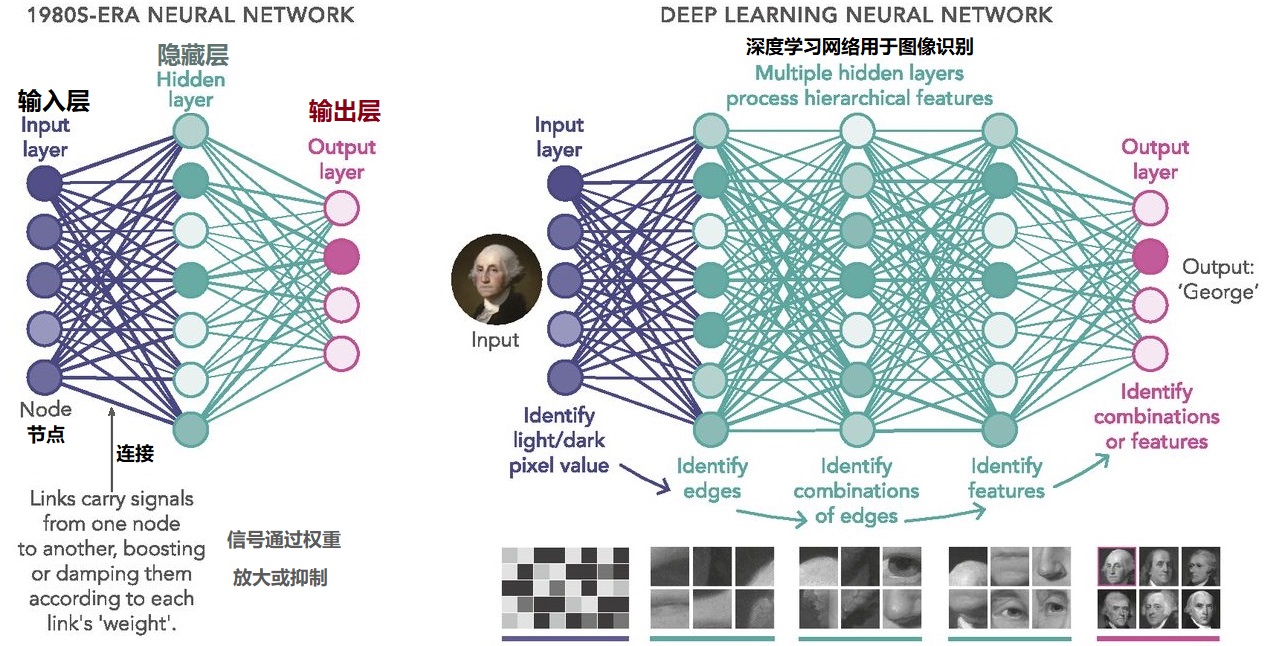

图6 深度学习神经网络与图像识别应用示意图。中间隐藏层越多深度学习越深

现在我们利用最广泛的深度学习和人脑比较来说明机器学习的原理(如图6所示)。任何一个深度学习系统都是通过一个模拟神经元节点的网络来处理信号,每一个节点代表一个神经元。信号沿着神经元的链接从一个节点传递到另一个节点,这类似于神经元之间的突触连接。而学习,就像在真实的大脑中加固链接强度一样,机器学习是调整节点的“权重”,权重会放大或抑制每个连接所传递过来的信号(线性变换)。在大多数深度学习网络中,网络会将节点排列成一系列层,类似于大脑皮层中不同的处理中心。比如,一个专门处理图像的网络会有一层输入节点,它们对单个像素做出反应,就像视杆细胞和视锥细胞对照射在视网膜上的光线做出的反应一样(见附注1)。一旦节点被激活(激活函数),这些激活节点通过加权连接将它们的激活信号从这一层传播到下一级别的其他节点,这层节点组合传入的信号并依次激活(或不激活)等等。这种过程一直持续到信号到达节点的输出层,在那里,激活模式会提供一个答案(附注1),例如,判断输入的图像是数字“9”。如果这个答案是错误的,比如判断输入的图像是“7”,深度学习会利用“反向传播”沿着层向下工作,重新调整权重,以便下次得到更好的结果,如此直到结果正确(这就是有标准答案的所谓监督学习的例子,最早的语音和图像识别系统都使用了所谓的监督学习,这也是反向算法有效的地方)。当然并非一切任务都有标准答案,所以与监督学习对应的另一类学习就是强化学习,它会有一个目标或评估函数(或奖励或惩罚机制),以此为目标来构建自洽反馈的理想算法,比如利用深度学习打游戏、下棋等。而把二者结合的最高成就为Google公司的AlphaGo系统,它把深度神经网络与蒙特卡罗树形搜索结合在一起通过训练战胜了世界围棋冠军李世石。

图7 机器学习人工智能的未来

所以深度学习的支持者认为:只要网络足够大(宽和深)或者多个网络配合就可以克服机器学习的弱点,实现真正的通用人工智能,然而事实真是这样吗?答案是网络规模无法解决通用人工智能的本质问题:智能的通用规则不是依靠准确的计算来解决的,它还需要依靠常识或直觉。人类思维的一个非常重要的方面就是它是理性和感性的结合,理性底层是逻辑,比如数学;而感性底层是直觉,比如美感、感动、信仰、敬畏等等,所以要想深度学习能够和人一样理解自然语言的意义,而不是靠记忆、整理和概率计算来处理语言,那当然需要为机器学习引入一种不同于传统算法的新模式。这个尝试依然需要借鉴人类的思维体系,比如引入类似潜意识的底层网络和清醒意识的上层网络,互相结合,模仿人类大脑的生理周期:清醒学习和睡眠整理模式,二者循环来优化神经网络,从而实现通用的机器学习模型。这就是2021年开发的神经符号贝叶斯系统:DreamCoder (Phil. Trans. R. Soc. A. 381, 2022, 0050)的意图,然而这个系统虽然提升了通用系统的准确度,但却牺牲了网络预测的处理速度。所以,机器学习系统的问题到底能不能被克服,它的能力极限到底在哪里,这个问题决定了人类人工智能发展的最后结局。

附注1:1981 年诺贝尔医学奖获得者David Hubel和Torsten Wiesel的主要贡献就是发现了视觉系统的信息处理过程是分层级的,这也启发深度学习网络分层级的原因。神经网络从数学逻辑上来讲就是它能通过机器学习找到任何一个映射函数(通过激活函数分段线性拟合任意函数),从而可以预测任何输入变量的输出值。

https://blog.sciencenet.cn/blog-318012-1445734.html

上一篇:我们不知道答案的125个科学问题(93)道德的生理基础

下一篇:我们不知道答案的125个科学问题(95)性格的形成