博文

深度学习多隐层架构数理逻辑浅析(十九)(7)

|

11.7 伽罗瓦基本定理对深度学习架构的启示

人类线性轨迹思维习惯,总是从低到高、从小到大、从左到右。最初的深度学习多隐层系统也是按照一阶线性逻辑习惯,每一个层次特征的分解切割空间构成一个隐层,低层隐层、中层隐层、高层隐层,逐层初始化、层层递进、逐级演算、各层次抽象特征泾渭分明。

①边缘线条、局部子特征、全局复合特征

②字母、单词、语句、段落、章节

③汇编语言、basic、c、c++、java、python、AI_agent

我们熟悉的线性空间分析系统看到的特征值是对角矩阵数元,但深度学习多隐层结构(表达复空间特性)的矩阵非对角元“非显性特征态”才是更加普适的表达系统,多头注意力不一定仅局限于transformer的QKV矩阵相乘。多头注意力机制是一种高阶逻辑,大可不必遵从碳基生物线性思维,其实完全可以从更高阶视觉直达张量场结构知识图谱。高阶AI系统(高阶张量参照系)凝视灵魂深处,更在于“特征不变子空间”的直和;深度学习多隐层结构的黑箱收敛,更在于“规范子群”直积。

无论是量子领域的诺特定律不变量,还是相对论的洛伦兹不变线元,在数学上都是群作用的不动点 / 不动元,它们都统一于伽罗瓦基本定理,能为深度学习多隐层系统结构提供参考。

一、群对称 ↔ (不变量 / 不变子特征)的对偶双射1.1、“对称性 ↔ 不变量”①诺特定理:

物理系统的连续对称性(李群作用) ↔ 守恒量(不变量)。这里的对称变换群与守恒流/荷构成了对偶。

诺特定律守恒量:诺特定律是李群作用下的动力学不变量。对称群对系统拉格朗日量的作用下,拉格朗日量的变分δL=0,守恒量是变分后的欧拉 - 拉格朗日方程的不动解;诺特将连续李群与物理系统的动力学结合,证明了每一个连续的整体对称变换,对应一个守恒量;每一个守恒量,对应一个连续的整体对称变换。对称性(连续李群)决定了物理系统的动力学结构,奠定了现代理论物理的基础,揭示了 “守恒量的本质是对称性”。 这是群论在理论物理的首次核心应用,将代数上的 “群对称” 转化为物理上的 “可观测守恒量”,定义了 “对称性刻画物理动力学本质” 的范式。

②洛伦兹几何:

在闵可夫斯基空间中,洛伦兹群( SO(1,3))作用下的不变量是时空间隔( ds^2 )。这是几何结构在(非紧致李群)作用下的“特征不变空间”,描述时空度规的不变性。

洛伦兹线元:是正交群作用下的张量不变量;洛伦兹群对闵氏时空的线性变换作用下,度量张量gμν是不变张量,线元ds^2=g_μνdxμdxν是不变标量;洛伦兹群是非紧半单李群(属于正交群O(3,1)的连通分支),其李代数so(3,1)与角动量 /boost 算符的对易关系一一对应。 洛伦兹变换的本质是闵氏时空的等距变换,线元不变性是伪欧氏流形的度量不变性,这是群论在微分几何的核心应用,定义了 “对称性刻画几何结构本质” 的范式。对称性(洛伦兹群)决定了时空的几何结构,奠定了狭义相对论的数学基础,揭示了 “时空的统一性”。若时空是弯曲的(广义相对论的黎曼时空),则洛伦兹群退化为局域洛伦兹群(每一点的切空间上的洛伦兹群),线元的整体不变性变为局域不变性,不变量从 “全局时空间隔” 变为 “固有时 / 标量曲率”,双射关系从 “全局洛伦兹群 - 闵氏时空” 变为 “局域洛伦兹群 - 切空间”。

1.2、伽罗瓦式对偶范式:“群作用 ↔ 不变/等变特征空间”

伽罗瓦理论:建立了域扩张( E/F )与其自同构群( Gal(E/F) )之间的反序包含关系。中间域对应子群,正规子群对应正规扩张(即具有完整对称性的子结构)。它描述有限伽罗瓦扩张中,域扩张的中间域与伽罗瓦群的子群一一对应,其中正规子群对应中间域的伽罗瓦扩张,不变量是基域元素在伽罗瓦群作用下的固定点。

虽然诺特不变量(Noether invariants)和洛伦兹不变线元(Lorentz-invariant line element)在严格的代数定义下并非伽罗瓦理论基本定理的直接推论,但它们共享了同一套“对称性 ↔ 不变量”、“群作用 ↔ 不变/等变特征空间”的深层逻辑核心结构同构,即「伽罗瓦式对偶范式」。“伽罗瓦式对偶范式”可理解为一种抽象的不变量母结构理论,其核心是通过群作用、子群、不变量空间与正规子群(规范子群)的对应关系,刻画“变换群-不变性”的一般模式。

| 理论 | 核心对称群(对称性的数学刻画) | 核心不变量(群作用下的不动元) | 特征不变空间(群作用下封闭的载体) | 核心对偶关系 |

|---|---|---|---|---|

| 洛伦兹变换线元 | 洛伦兹群L(3,1)(含庞加莱群P(3,1),含时空平移) | 闵氏时空线元ds2=−c2dt2+dx2+dy2+dz2(度量不变量);四维时空间隔、固有时 | 闵氏时空M4(四维伪欧氏流形);张量空间的不变子空间(如标量场、洛伦兹张量的不可约表示空间) | 洛伦兹群的表示 ↔ 闵氏时空的张量不变子空间 |

| 诺特定律 | 物理系统的连续对称李群(如时空平移群、旋转群、洛伦兹群、内对称群U(1)/SU(2)/SU(3)) | 守恒量(能量、动量、角动量、电荷、同位旋等);哈密顿量 / 拉格朗日量的对称不变性 | 系统的相空间 / 组态空间;守恒量张成的相空间子空间(如能量守恒对应相空间的等能面) | 连续李群的李代数生成元 ↔ 守恒量算符的泊松括号代数(同构) |

| 伽罗瓦基本定理 | 有限伽罗瓦扩张K/F的伽罗瓦群Gal(K/F)(域K的F- 自同构群,有限群 / 代数群) | 伽罗瓦群作用下的不动元(Gal(K/F)子群的不动域元素);多项式的判别式、根的对称函数 | 域K作为基域F上的线性空间;伽罗瓦扩张的中间域(F⊆L⊆K) | 伽罗瓦群的子群格 ↔ 中间域格(反序对偶同构) |

严格而言,诺特不变量、洛伦兹不变线元,并不是「域论版本伽罗瓦基本定理」的严谨数学定义下的特例,但它们全都是「伽罗瓦式对偶范式」—— 即【群作用 ↔ 子群 ↔ 特征不变空间 ↔ 正规子群 = 规范子群— 不变量】这一抽象不变量母结构理论的特例。诺特、洛伦兹是伽罗瓦对偶范式(抽象群作用 - 不变空间理论)的特例;洛伦兹 / 诺特 = 伽罗瓦对偶范式在李群(连续对称)+ 几何 / 物理空间下的延伸。洛伦兹、诺特是这套范式在连续李群、几何流形、物理变分下的自然推广。伽罗瓦基本定理是这套范式在离散代数域、有限群、域扩张下的原始、最严格版本。它们都以 正规子群(规范子群)作为 可分解、可做商、可定义规范对称、保持结构封闭的核心单元,共享同一核心对偶 群 G 的子群 ↔ G 作用下的特征不变空间(反序双射)。伽罗瓦不动元在几何 / 物理中的特征不变空间上的群作用不动点,直接对应不变量(诺特守恒量、洛伦兹线元)。“统一母结构”为:

伽罗瓦:X=域 K,G=伽罗瓦群,不变量 = 不动域元素

洛伦兹:X=M^4,G=洛伦兹群,不变量 = 线元 ds^2

诺特:X=场/相空间,G=连续对称群,不变量 = 守恒荷

群作用不动点定理是伽罗瓦/诺特/洛伦兹理论的通用数学基础,将不变量统一为群作用下的不动点,特征不变空间统一为不动点集,正则性条件都是不动点定理成立的充要条件;洛伦兹李代数与守恒量的对易关系同构,是诺特定律“连续李群对称→守恒量”的核心数学表达,体现了“代数对称结构(李代数)→物理可观测守恒量”的严格映射,也是洛伦兹对称与诺特定律的本质绑定;群结构(伽罗瓦/洛伦兹/诺特)→李代数/群作用→不动点定理→不变量(不动点)/特征不变空间(不动点集),其中群论是语法,李代数/群作用是句法,不动点定理是规则,不变量/特征不变空间是语义。

以群结构刻画对称性为核心,不变量是对称性的具象化标识,特征不变空间是群作用下保持封闭的不变量载体,而三大理论的核心贡献都是建立了抽象群对称结构与具象的不变量 / 不变结构之间的严格一一对应(对偶性)。量子力学和相对论的不变空间,是群论的线性空间在不同领域的 “结构赋权”,从纯代数的 “加法 / 数乘”,到几何的 “度量”,再到物理的 “动力学”,但底层的群作用不变性从未改变。任何数学 / 物理结构的本质特征,由其自身的对称性决定;对称性的数学刻画是群结构,本质特征的具象化是不变量,而特征不变空间则是对称性与不变量的几何载体,三者通过严格的对偶双射绑定,构成了结构的 “对称 - 不变” 核心骨架。从伽罗瓦的代数对称,到洛伦兹的时空对称,再到诺特的物理对称,人类对 “对称性” 的认知,从纯代数的抽象概念,逐步发展为刻画宇宙代数结构、几何结构、物理结构的通用语言。而群论则是这个语言的语法,不变量是词汇,特征不变空间是语境,共同构成了现代数学和物理的核心框架。

1.3、线性空间的彼岸是乘法群

频域很多个抽样点组成的子集合与时域多个抽样点的组成的子集合之间存在对应性质,正如伽罗佤理论中的正规子群(子集)和特征解子空间(子集)的对应关系。虽然两个对偶空间的元素与元素之间不存在一一对应关系(不确定性原理不允许波粒二象性出现实空间不动点),但是对偶空间两种子集合之间却有明确对应。矩阵行列向量、核磁共振、电磁场、诺特定理、洛伦兹变换等,都说明对偶空间二阶复合系统守恒量具有普遍意义。既然二阶复合体行之有效的对偶对称经验,推广到更高阶系统是否可行?既然二阶空间固有特征根系,那么更高阶的张量系统如何度量不变特征子空间呢?

① 诺特定理:对称与守恒的对应性,一个守恒定律可以找到一个对称与之对应,反之亦然。

② 伽罗瓦定理:群与特征属性对应性,一个不变子群可以找到一个不变子特征根系与之对应,反之亦然。

可见,伽罗瓦定理是诺特定理的升级版。伽罗瓦理论是用群论的方法来研究代数方程的解的理论。伽罗瓦天才地建立了代数方程的伽罗瓦域的子域与它的伽罗瓦群的子群间的一一对应关系,证明了代数方程能用根式解的充分必要条件是其伽罗瓦群为可解群。如果特征元无穷加的对偶彼岸是特征元无穷积,显而易见,线性空间的彼岸是乘法群,反之亦然。

二、伽罗瓦基本定理

伽罗瓦基本定理 = 伽罗瓦对偶范式在有限群 + 域扩张下的代数原型

设 G 为群(离散 / 连续),X 为 G 作用的空间(域 / 时空 / 相空间 / 特征空间),则:

子群 H≤G ↔ 特征不变空间 XH⊆X(反序)

正规子群 H◃G(规范子群) ↔ 不变空间可做商空间 X/XH,结构可分解、可规范、无混杂

不变量 = X 中被全群 G 固定的对象(不动点)

伽罗瓦群对域K的自同构作用下,不动域KH={x∈K∣σ(x)=x,∀σ∈H}(H≤Gal(K/F))的元素,数值 / 代数结构在自同构下不变。伽罗瓦群是域的自同构变换群,洛伦兹群是时空的等距变换群,诺特定律的对称群是物理系统的组态 / 相空间变换群——变换群是对称群的共同抽象本质,而不变量 / 不变空间,就是变换群作用下的不变对象 / 不变子集。“特征不变空间”是统一的定义:由不变量张成、在对应群的作用下保持封闭的空间,是对称性的几何化体现;而 “不变量” 则是这个空间上的群作用不动元(数值 / 结构在群变换下恒等)。

封闭性:群作用于不变空间内的任意元素,结果仍在空间内(如洛伦兹变换作用于闵氏时空的任意点,结果仍在闵氏时空;伽罗瓦群作用于中间域的任意元素,结果仍在中间域);

完全性:对称群的不可约表示,完全刻画了不变空间的不可约分解(如洛伦兹群的不可约表示对应相对论性粒子的自旋;伽罗瓦群的不可约表示对应多项式的不可约因子;诺特定律的李群不可约表示对应守恒量的量子数);

函子性:群的同态 / 商群,对应不变空间的同态 / 商空间(如伽罗瓦群的商群Gal(K/F)/H对应域扩张K/KH;洛伦兹群的商群对应时空的商流形;诺特定律的对称群商群对应守恒量的等价类)。

💎【伽罗瓦基本定理】商群Hi/Hi+1与Gal(Ki+1/Ki) 同构。

对于伽罗瓦扩张K/F,存在着伽罗瓦群Gal(K/F)的子群与扩张的中间域之间的一一对应关系。具体来说,若H是Gal(K/F)的子群,那么H的不动域是一个中间域;反之,对于任意中间域E,存在Gal(K/F)的子群Gal(K/E)与之对应。并且,E/F是正规扩张当且仅当Gal(K/E)是Gal(K/F)的正规子群。随着域的扩张,群的变换性受限,群的阶数缩小。因此,域扩张特征子空间反序对应正规子群。伽罗瓦基本定理要点是域扩张,添加一个元素到较小的域中来构造较大的域。域扩张获得新的特征根系,扩展新特征子空间(这里的域是子集,而不是一个元素。群生成元和域特征根的点与点之间并不一一对应,类似不确定性原理)。

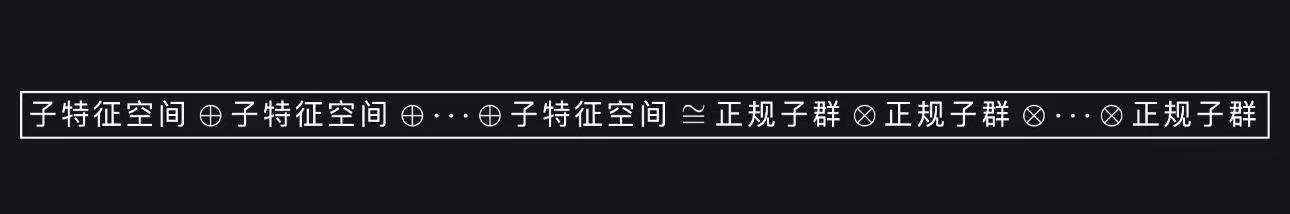

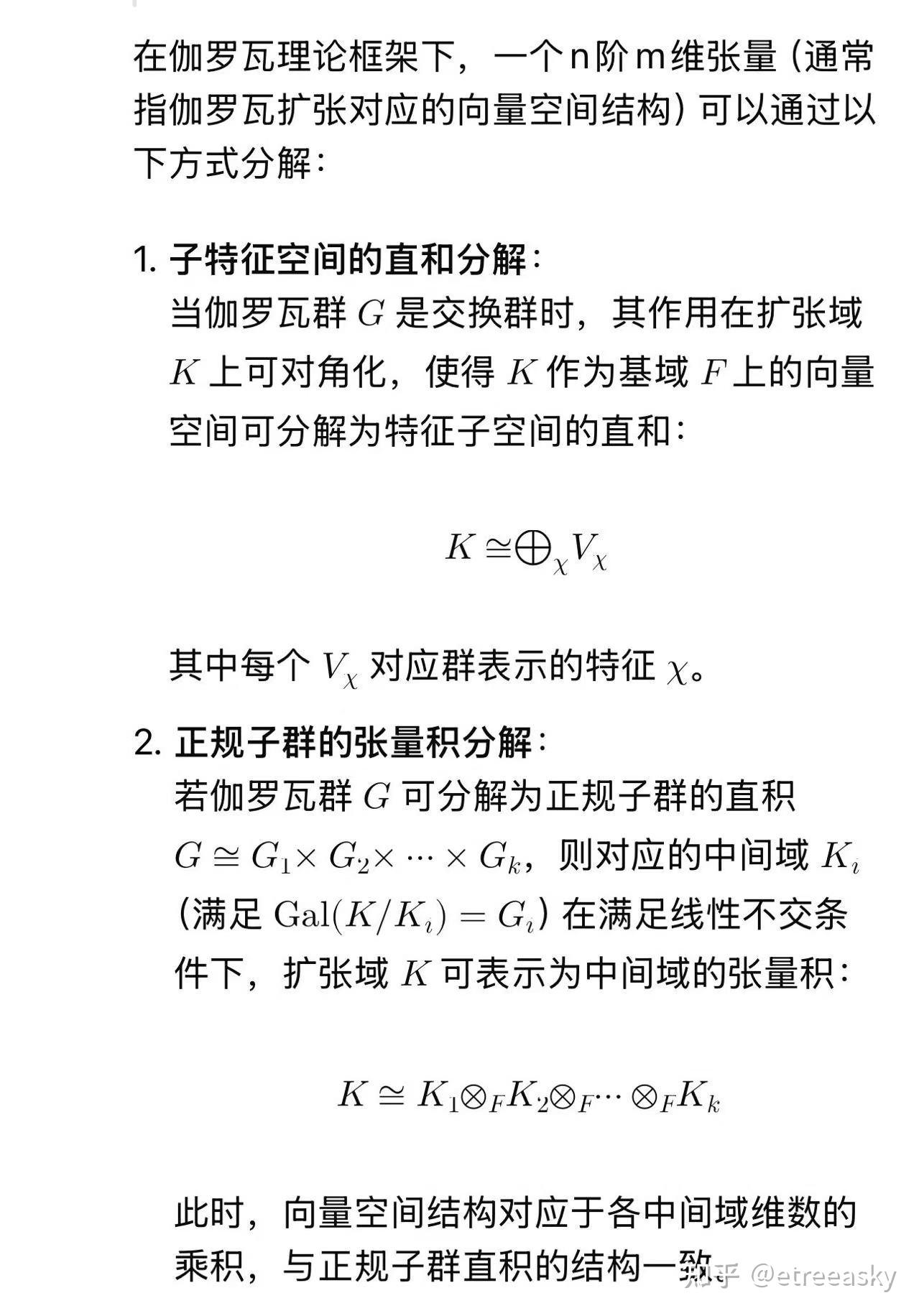

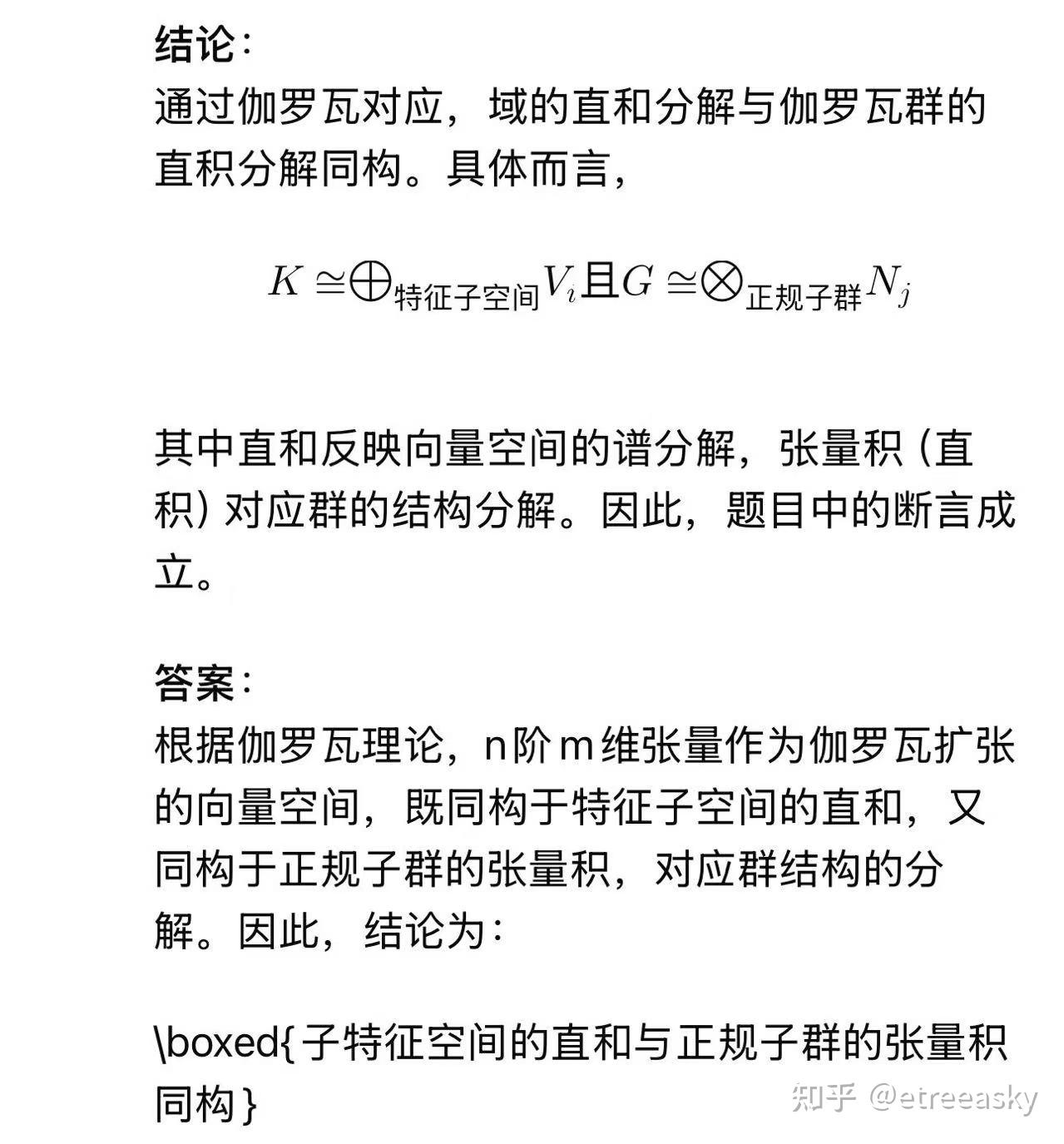

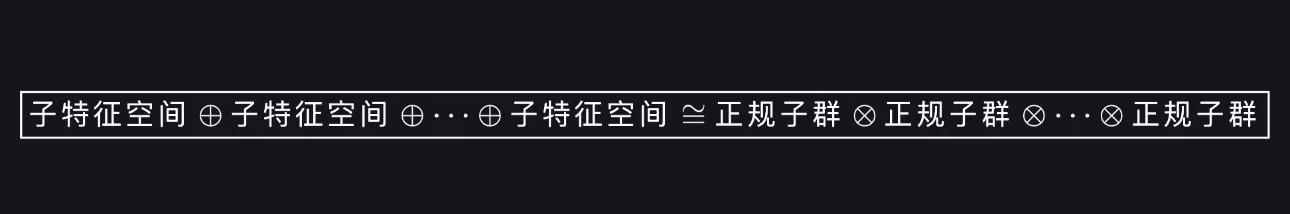

因而有,高阶张量分解的有效路径:

n阶m维张量 同态于: 子特征空间⊕ 子特征空间⊕ 子特征空间⊕……,

并且根据伽罗瓦定理,也同态于: 正规子群⊗正规子群⊗正规子群..........

“特征不变子空间”的直和,等同于“规范子群”直积。

三、特征不变空间 + 规范子群 → 🧠对深度学习的核心结构升级启示

能否将神经网络从传统拟合样本升级为拟合对偶对称性规范结构,重构多隐层的多层规范扩域特征子空间、以及进化多头注重力将每个头形式一个规范子群?

| 抽象数学 / 物理 | 深度学习对应(多隐层 + 注意力) |

|---|---|

| 群 G | 数据上所有等价变换(平移、旋转、语序换、同义替换) |

| 子群 H | 某一类局部 / 特定对称(如位置对称、语义对称、结构对称) |

| 特征不变空间 X^H | 某一层 / 某一个注意力头 学到的封闭特征子空间 |

| 正规子群(规范子群) | 可独立、可并行、可组合、可商、无交叉污染的模块 |

| 不变量 | 泛化特征、鲁棒特征、语义守恒量(诺特) |

| 内蕴度量(线元) | 特征空间的内蕴距离,等价变换下不变(洛伦兹) |

3.1、将‘伽罗瓦规范子群’引入多隐层不变特征子集结构塔

当前深度学习的多隐层结构多采用“特征映射→非线性变换”的黑箱模式,而伽罗瓦式对偶范式提供了结构化的对称破缺路径。 群作用对应层间变换, 规范子群对应层间约束。伽罗瓦式子群链的深度层级不再是 “堆叠”,而是对称约化 + 不变量逐层固化。

理论而言,伽罗瓦理论指引可将黑箱暗结构(包含了矩阵非对角元表达的非显性特征纠缠态的各种旋量复合的结构)进行模块层规范分解,层间构成不变空间塔,各隐层伽罗瓦式子群链直积(具体实现方式这里暂且不提,后面章节详述)。

实际环境中满足这样的苛刻条件并不容易,过于理想化模型适用可能范围受限。当前阶段,更贴近实际广泛场景,更容易优化改进的构造,也许需要寄希望到多头注意力机制的升级。

3.2、将‘旋转特征元’引入多头注意力机制

多头注意力本质上天然就是伽罗瓦对偶 + 规范子群的离散实现,只是大家一般没从群论角度来看。多头注意力机制的本质是对特征空间的并行子空间划分,伽罗瓦式对偶范式为其提供了正交化优化框架。 多头注意力的子空间分工,多头注意力将输入映射到多个子空间“头”,每个头可视为对一个子群的响应。若设计“群等变多头”,可使每个头的特征在特定群作用下等变(如旋转群作用下特征同步旋转),最终通过不变量聚合(如取子空间均值)获得全局不变性。

| 维度 | 多次平移复合 | 多次旋转复合 | Transformer 并行复合权重 |

|---|---|---|---|

| 群结构 | 交换阿贝尔群 | 非非交换李群 | 底层嵌入非交换群特性 |

| 复杂度 | 不爆炸,始终简单 | 强耦合,极度复杂 | 深度堆叠后复杂度无限生长 |

| 关系建模 | 无相对方位,仅平铺 | 固化相对夹角 / 关联 | 用注意力权重建模语义「相对旋转关联」 |

| 操作表象 | 有顺序也无所谓 | 顺序决定结果 | 表层无顺序,底层藏顺序敏感的旋转复合 |

Transformer 「无顺序并行复合权重」,表层抹掉顺序,底层完全复用旋转非交换复合的结构化能力,彻底摒弃平移的平庸性。Transformer 思路,表层无顺序并行,是把「旋转复合的顺序敏感性」封装在矩阵权重里;底层每一组 Q/K/V,都是一次独立的轴 / 角度不同的旋转变换叠加。Attn=softmax(QK⊤)V,WQ,WK,WV把输入投影到多个高维旋转子空间(多头);QK⊤ 内积就是旋转不变相似度—— 度量两个向量在子空间里的「夹角 / 方位关系」;Softmax 权重是并行化的、概率化的、多旋转路径、非交换旋转复合;加权求和把所有「旋转对齐后的关联信息」融合。

群属性:非交换李群、有生成元、有李代数、可迭代纠缠

核心:绕不同轴、不同角度、不同顺序旋转,会合成全新旋转 + 挠场结构(三维最典型:欧拉角万向锁、旋转耦合)

本质:旋转能固化相对方位、绑定关联关系、生成高维隐结构—— 这是一切复杂智能 / 几何的源头。

不同头 = 不同旋转轴;

不同权重 = 不同旋转角度;

深度堆叠 = 多层旋转嵌套复合; 天然能编织:高阶关联、隐层拓扑、抽象推理 ——这正是多旋转乱序复合能生成复杂结构的同源能力。

Transformer「无顺序并行复合权重」:对外抹平操作顺序,对内用矩阵 / 多头 / 权重,完整继承多维度、多角度、可嵌套的旋转变换非交换复合能力,用旋转的结构化复杂度,替代平移的平庸累加,从而具备建模一切复杂关联的底层天赋。

①把“90度旋转的转置矩阵”引入多头注意力的矩阵中

由于复杂结构完备性需要依赖“对偶互补对称不变量”,而希尔伯特空间傅里叶谱分析反映对偶空间基本粒子性的对易子含有虚数i,所以考虑把虚数i(空间旋转90度功能)对应的‘旋转90度转置矩阵’引入多头注意力的矩阵中。

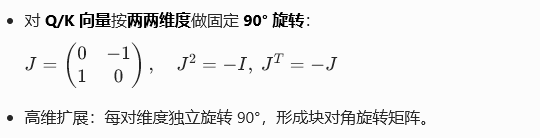

线性代数意义上的旋转,在 Q/K 向量的特征维度内部,对每两个维度做 90° 旋转。对应矩阵J=(01−10),典型就是 RoPE 旋转位置编码,编码相对位置信息,不改变注意力作用在哪个轴,注意力仍然在时间 / 序列轴。RoPE 简化版:

优化效果:强相对位置感知,点积满足⟨(J^m)qi, (J^n)kj⟩=⟨qi, (J^n−m)kj⟩,仅依赖相对距离 n−m,天然建模序列顺序;距离越远,旋转累积越大,相似度自然衰减,符合语言 / 时序规律。 正交稳定、数值安全,J 是正交矩阵:JTJ=I,特征模长 = 1,防止梯度爆炸 / 消失,深层训练更稳。 特征解耦、去相关,旋转强制特征正交化,减少冗余,提升维度利用率。 计算轻量,块稀疏、仅符号翻转,O (d) 计算,几乎无额外开销。低成本大模型首选,位置感知强、轻量、稳定、易部署,更好的相对位置、训练稳定、维度高效。相对位置编码、序列建模、轻量稳定,NLP / 语音 / 时序通用强,工业界已大规模验证有效。

局限:固定旋转:表达有限,不如可学习角度灵活;仅位置 / 时序有效,对无结构数据增益小;长序列仍有外推衰减(需动态频率修正)。

② Kimi团队“纵向注意力机制旋转90度”(时间-深度对偶)

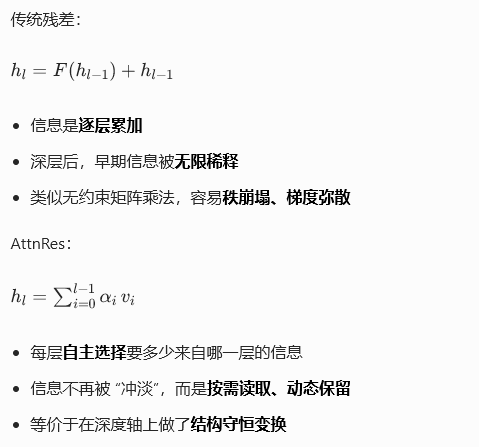

Kimi团队通过时间-深度对偶性的数学结构,根据网络的深度维度和序列的时间维度本质上的同构。类似于Transformer用注意力机制让每个token选择性关注序列中任意位置的token解决了RNN的遗忘问题, Kimi团队提出的“注意力机制旋转90度”技术(Attention Residuals),它通过将注意力机制从序列维度扩展到深度维度,解决了传统残差连接长期存在的信息稀释问题,使模型训练效率提升25%且推理延迟仅增加不到2%,达到相同性能需要的训练计算量减少约20%,相当于获得1.25倍的效率优势。

传统方式:第N层输出 = 第N层计算结果 + 第N-1层输出(固定加法累加)

AttnRes方式:第N层输出 = Σαᵢ·vᵢ,其中αᵢ是当前层对第i个历史项的可学习注意力权重

可学习伪查询向量:每层有一个可学习的query向量wₗ∈Rᵈ,不依赖实时输入,仅与层本身相关

RMSNorm归一化:在计算注意力权重前,对所有前层输出(key)进行归一化,消除不同层输出量级差异

零初始化策略:所有伪查询向量初始化为0,训练初期注意力权重均匀分布,保证训练稳定性

分块压缩:将L层网络分成B个block(通常B=8-16),每个block内部沿用传统残差

块间注意力:后续层做attention时,只需关注块间表征+块内实时层输出

复杂度优化:从O(L²)降至O(L·B),使计算量从不可行变为实用

AttnRes将传统残差的固定求和替换为注意力加权和: hₗ = Σᵢ₌₀ˡ⁻¹ αᵢ·vᵢ, 其中vᵢ 是历史层表示(v₀可看作原始输入),αᵢ 是当前层对第i个历史项的注意力权重,满足Σαᵢ = 1,注意力权重计算为:αᵢ = exp(qᵀ·RMSNorm(kᵢ)) / Σⱼexp(qᵀ·RMSNorm(kⱼ))。这种转变使信息流从”逐层叠加”转向”按需读取”,在深层网络中保持更稳定的信息表达。从固定累加到选择性聚合 传统残差连接与Attention Residuals的核心区别:横轴(时间/序列),Transformer用注意力机制让每个token关注序列中任意位置;纵轴(深度),AttnRes让每一层去关注前面任意层的输出,解决残差连接的稀释问题。

需要特别说明的是,Kimi 的「注意力机制旋转 90 度」是结构旋转,它没有用到任何 90° 旋转矩阵,没有 J,没有维度内旋转,没有 RoPE 式旋转编码。它只是把注意力的作用维度,从 “横向序列” 旋转 90 度变成 “纵向深度”,是注意力作用轴的旋转,不是矩阵旋转。

Kimi AttnRes旋转的是 “注意力作用的轴”,序列轴 → 深度轴,(结构旋转,无矩阵旋转)。 90° 旋转矩阵注意力:旋转的是 “特征空间内部的向量”对 q/k 做维度内旋转变换,(真实矩阵旋转,轴不变)。它们唯一的共同点,都用到了 “对偶” 思想。Kimi是时间 ↔ 深度 对偶,转置矩阵旋转是位置 ↔ 动量、维度 ↔ 维度 对偶,所以都可以被放进辛结构、对偶性、相空间统一框架下理解。

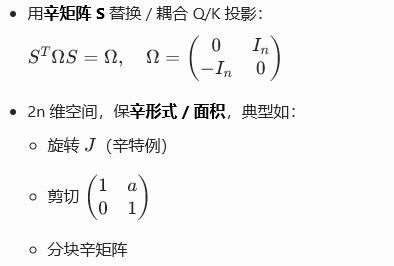

③辛矩阵(S)引入多头注意力

辛矩阵作为统一对偶算子

优化效果: 保辛结构,哈密顿 / 动态系统建模,严格保相空间体积 / 面积,适合物理仿真、轨迹预测,时序动态、能量守恒系统,最优控制、微分方程建模; 强长程稳定性、无秩崩塌,辛变换保秩、保行列式 = 1,深层堆叠不坍缩,无 rank collapse,适合极深 Transformer; 对偶特征耦合(q↔k 对偶性),自然建模共轭变量对(位置↔动量、电压↔电流),适合多模态配对、图对偶、对称关系任务; 抗扰动、泛化强,辛群光滑、紧致,优化 landscape 更良性,小数据下正则化强、过拟合低。专业场景利器,极深层、物理 / 动态系统、对偶任务、强正则,保结构、抗坍缩、长程保真、小数据强泛化。深层不坍缩、保动态结构、对偶特征、长程保真,通用场景提升有限,但物理 / 动态 / 极深模型显著更强。

局限:计算更重,一般非稀疏,矩阵指数 / 分解成本高;维度强制偶数2n×2n,结构约束强;领域特定:NLP / 视觉通用场景增益有限;辛约束下参数化复杂,可学习性资源消耗大。

④“时间 - 深度对偶 AttnRes + 90° 旋转矩阵 + 辛注意力” 三者统一融合

90° 旋转矩阵(时间轴)与 Kimi AttnRes(深度轴)是互补优化,前者提升序列建模能力,后者提升深层信息保留,无效果重叠与抵消。辛矩阵作为统一对偶算子,为两者提供结构守恒约束,进一步提升训练稳定性,减少秩崩塌风险,不会额外增加大量计算(因共用算子、结合分块压缩)。

90° 旋转矩阵负责:时间轴位置与正交性

辛矩阵负责:时间 - 深度对偶与结构守恒

AttnRes负责:深度轴信息流重构

三者融合后,得到一个严格对偶、结构守恒、深层稳定、长上下文强、训练高效的统一 Transformer 优化架构。预估训练计算量−20%~30%,推理延迟上升<2%,深层不坍缩得以改善解决,长程依赖接近完美优化,整体效率倍数≈1.3~1.4×倍数。

共用对偶算子 Ω:减少参数冗余,强化时间 - 深度对偶性,降低模型过拟合风险,提升泛化能力;统一对偶算子共用 Ω,时间旋转、深度辛打分,共用同一个辛矩阵 Ω;不再两套参数,减少冗余,强化时间 - 深度严格对偶;结构更紧致,泛化更强,训练更稳。

深度轴旋转编码:让模型显式学习层深度的位置信息,使深度注意力权重更有规律,加速模型收敛;深度轴也加入旋转编码,对层索引 ℓ 也做 90° 旋转编码,让模型显式学习深度位置,深层注意力权重更有规律,更早收敛。

辛约束 + 分块 AttnRes:在保结构守恒的同时,将复杂度从 O (L²) 降至 O (L・B),保证工程实用性;辛约束 + 分块 AttnRes 结合,块内普通残差、块间辛深度注意力,复杂度O(L⋅B) 保持高效,效果既快又保结构。

辛流形初始化 / 联合归一化:提升训练稳定性,避免梯度爆炸 / 消失,均衡跨层、跨 token 的信息分布。 零初始化 + 辛流形初始化,查询向量初始在辛流形上,而非随机;训练初期权重接近均匀,不震荡;极深层训练稳定性显著提升。 联合归一化Time-Depth Symplectic Norm,对时间注意力、深度注意力做联合归一化;保持整体辛结构不变,跨层、跨 token 信息更均衡。

块大小调优:深层模型(>100层)B=4 ~8层一次深度注意力,浅层模型B=16 ~32层一次深度注意力。频率学习:时间轴旋转频率可学习,避免固定90°的位置局限。初始化严格:必须用辛初始化,随机初始化破坏结构。监控训练:跟踪辛漂移和特征秩,及时调整。

该融合方案在保留Kimi注意力残差核心优势的基础上,通过辛矩阵的统一对偶约束实现了时间轴与深度轴的结构化融合,既解决了传统残差连接的信息稀释问题,又通过工程优化保证了方案的落地实用性。上述模块并集成到现有Transformer 框架中,所有组件均基于现有成熟技术(RoPE、辛矩阵、分块注意力),无理论障碍。

https://blog.sciencenet.cn/blog-1666470-1528602.html

上一篇:深度学习多隐层架构数理逻辑浅析(十九)(6)